对于技术泡沫,大家可能最熟悉的就是Gartner的技术成熟度曲线图。过去几年确实出现了许多备受关注的技术,例如云计算、大数据、区块链和元宇宙。新技术让人激动,但很多企业在跟进这些技术时往往犹豫不决,担心不下注未来会被淘汰,也担心投入巨大但方向错误。

例如,前几年Facebook押注元宇宙,甚至将公司名称改为Meta,但元宇宙的技术成熟度和市场发展并未达到预期。幸好,Meta公司在大模型时代及时调整方向,特别是在开源大模型上为社区做出了巨大贡献。那么,这次大模型的技术发展周期是怎样的,会出现短期见顶的情况吗?

Meta于7月23日发布了Llama 3.1 405B开源人工智能模型,这是Meta迄今为止最强大的模型,也是目前全球最强大的开源大模型。在某些方面,超大杯Llama 3.1 405B超过了GPT-4 0125,与GPT-4o和Claude 3.5互有胜负。例如,它在NIH/Multi-Needle基准测试中的得分为98.1,在ZeroScrolls/Quality基准测试中的得分为95.2,在处理长文本方面表现出色,在Human-Eval基准测试中也略占上风。

从最终效果来看,大力仍能出奇迹,Scaling Law依然有效。在Llama3.1的大模型中,70B和8B大小参数的模型也比之前的版本有了非常大的性能提升,这两个规模的开源模型非常适合企业部署。

从2022年底OpenAI推出大模型后,从一开始的聊天应用,到后来的RAG,Agent,多模态,视频处理等,AI的应用落地实践其实是越来越成熟,开源的大模型也被广泛应用在企业的各种业务场景中。

但是由于所有的大模型都几乎用同一套标准的接口,使得大模型很难像传统软件那样打造专属的生态圈,从而建立竞争护城河。用户从一个大模型切换到另外一个大模型,几乎不需要什么成本,每个月都会有更新更好用成本更低的大模型出来。这也使得市场和投资界对大模型的商业价值持疑态度,认为其发展可能类似于几年前的各种技术概念泡沫。

Llama 3.1 405 模型是在一个包含了16384 块Nvidia H100 80GB GPU 集群上训练了整整54天,其中出现了417 次意外中断。如果按照每小时每张卡3美金的H100租赁成本,加上CPU、内存、磁盘、网络等硬件资源每小时预计5美金的成本来算,这次训练就需要1亿美金的硬件成本。再加上数据购买、人工训练、维护和调优的费用,一次大模型的训练成本可能超过2亿美金。而目前SpaceX发射一次星舰火箭的成本也不到一亿美金,这已经是当前商业航天里运力最强的火箭。

目前,人类正以极大的热情投入AI领域,受益于AI的火热,英伟达的股价在两年内上涨了10倍以上,市值超过3万亿美元。每个月都有企业宣布推出新的大模型,消耗了几个小目标,不断地刷新榜单。这不禁让大家联想到20世纪60年代美苏争霸时期的太空竞赛。

1957年苏联成功发射世界上第一颗人造卫星——斯普尼克一号。1958年,苏联宇航员尤里·加加林成为第一个进入太空的人,乘坐东方1号(Vostok 1)绕地球飞行。这一事件引发了美国的极大震惊和反应,美国总统艾森豪威尔签署了《国家航空航天法》,成立了美国国家航空航天局(NASA),以应对苏联在太空竞赛中的领先地位。

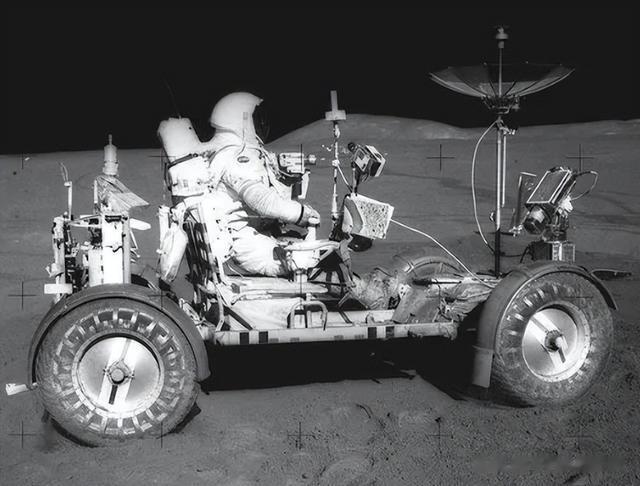

在1969年,美国成功实现了载人登月计划。阿波罗11号任务中,尼尔·阿姆斯特朗(Neil Armstrong)和巴兹·奥尔德林(Buzz Aldrin)成为首批登上月球的人类。阿波罗计划共进行了17次任务,其中6次成功登月,最后一次是1972年的阿波罗17号。阿波罗计划的实际支出略高于预算,大约为257亿美元。按现值计算,其花费相当于2000亿美元,但它实现了人类历史上的重大突破。太空竞赛的角逐中,除了航天技术以外,还推动了计算机技术、材料科学和通信技术的进步,我们今天非常多的技术都孵化于当年的太空探索。

很多人可能会很好奇,既然登月计划那么成功,人类为什么没有继续转向火星和更远的太空呢?首先,技术上的挑战远超预期。火星距离地球遥远得多,火星到地球的距离约为月亮到地球距离的586倍;长达数月甚至数年的航行时间,以及在陌生星球上生活所需的复杂生命支持系统,都给科学家们带来了前所未有的难题。其次,高昂的成本也是一个无法忽视的因素,预计火星任务的预算将至少比阿波罗计划高10倍以上。现实是资源有限,必须优先处理地球上的诸多问题,地球上即使是生存条件最恶劣的地方也比月球和火星更宜居。

尽管当时的各国政府和科学家们对太空探索都充满热情,但下一个目标跨度太大、成本太高,让单纯的刷榜行为失去了动力。阿波罗登月这一事件被认为是太空竞赛的巅峰,之后美苏的竞争反而转向了地球轨道空间站和无人深空探测等方向。

目前,大模型的训练可能也会遇到类似的瓶颈,那就是下一个目标的成本可能高不可攀。目前最强的开源大模型已经达到了4000亿参数,但仍未实现通用人工智能。假设下一步量变引起质变的规模是十万亿参数,训练更大的模型往往需要更多的参数,其整体训练量和成本的增加远超过参数增长倍数。训练十万亿规模参数的大模型,可能需要几十万张H100的显卡的集群这样一次训练的成本可能达到100亿美元。从过去的太空竞赛来看,100亿美元单个项目可能是目前人类社会能承受的极限。毕竟,下一个量级的百万亿参数大模型,其对应训练总成本很可能超过1万亿美元,这几乎是无法实现的。

如果100亿美金砸下去了,10万亿规模参数的大模型还是没法实现AGI,那么基于Transformer架构的大模型是不是短期就到头了?不过这个结果很可能会启发人们去探索Transformer之外的架构体系,例如量子计算,类脑芯片等。

10万亿规模参数的大模型,会是Transformer架构的登月时刻么?