前天聊了蔚来的NWM之后,有读者提问题:

这个视频生成质量应该到不了网络训练的程度吧?

然后昨天又看了下NIOIN的视频回放。

确实发布会的视频到不了网络训练的标准。

但是这些视频其实并不是用来展现训练能力的,而是展现推理能力。

而我们在开车的时候并不是眼睛看到的所有信息都是有效的,例如绿化带种的什么树不重要,有些广告上的字也不重要。

所以某种程度上这些视频的推理也不重要。

当然这部分模型因为要上车端,更高质量视频生成势必带来更高的算力要求,所以在合理的区间内降低质量也是可以想象的。

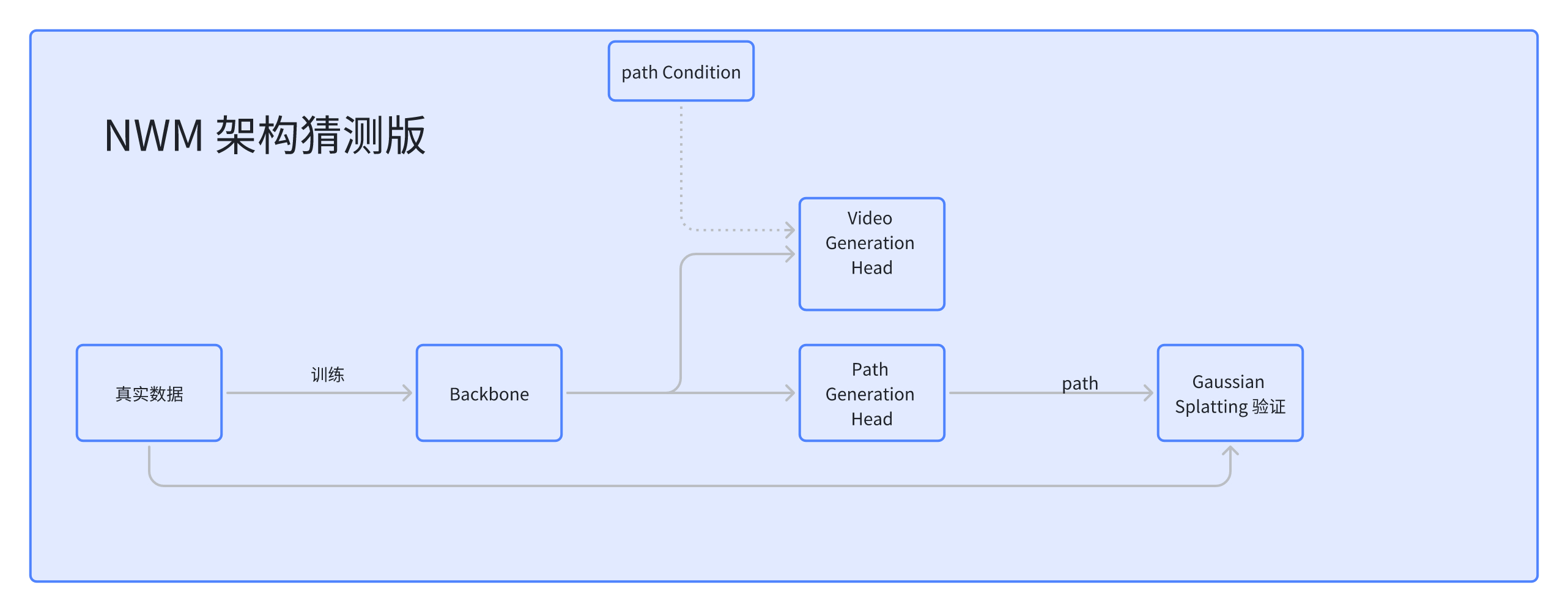

这里因为没有看到架构图,根据一些论文和目前的宣传大概能看出来方案如图一。

整体方案就是:

在海量视频中训练生成视频的网络,然后将这个网络迁移到轨迹生成,这些轨迹也可以再次作为条件去生成视频,找到最优解决方案,并且可以用这个轨迹在3D重建中进行验证,从而让网络不断进化。

换句话就是,在视频中学会理解世界,然后将这些信息拿过去学开车。

视频生成不是目的,而是过程。

#汽场全开# #nio in 2024 蔚来创新科技日#