叠甲1: 地平线是我非常尊敬的一家公司,CVPR 最佳论文 端到端 UniAD 地平线也是参与单位

叠甲2: 地平线基于自研软硬件一体化的智能驾驶方案具备足够宽的护城河和先进性

叠甲3:这篇微博只针对这一篇推文,从研发到产品到宣发,每一个层级都有不少信息流失,我相信实际上地平线有非常好的端到端研发策略。

只是我觉得既然要做宣发,把一件事情说的逻辑清晰是最低的要求。这篇文章没做到。

文章见评论区

正文:

地平线的这篇文章首先提出:

【世界模型比较普遍的定义是,整合多种语义信息(如视觉、听觉、语言等),通过机器学习、深度学习和其他数学模型来理解和预测现实世界中的现象、行为和因果关系。】

这没问题,世界模型的定义就像大模型一样,并没有一个公认的定义。Tesla 和Wayve的定义与这个虽有差异,但是也强调了通过现象的行为预测。

接下来文章里开始讲端到端自动驾驶的弊端,黑盒问题和下限不可预测问题,需要有世界模型来处理下限,这里也没有问题,虽然不是公认解决方案,但是理想VLM,蔚来的世界模型也提供了类似的解法。

【世界模型的作用开始显现:一是通过生成式大模型生成带有预测性质的视频数据,实现corner case多样化训练;二是采用强化学习的方法认识复杂驾驶环境,从视频输出驾驶决策。】

到目前为止,还是一篇正常的科普。

但是往下,形势急转直下,开始不知所云起来。

话锋一转,突然开始描述地平线mental model使得他能够在理解常识的前提下,具备和驾驶环境交互博弈的能力,最后以 【此时世界模型就承担了「驾驶世界观」的作用】作为结尾,而且从头到尾一个句号和转折都没有。

那么, 我请问mental model 就已经是世界模型了?

那已经靠着并不是巨大算力,上量产的地平线真是断层断代领先了。

这里我们姑且是认为我的理解能力不到位,只是一个简单描述和展望,文笔不够流畅带来的歧义。我们接下去看。

这个时候这篇文章突然说、

【世界模型通过收集各种信息,进行综合理解,输出一个下游能够使用的、包含了隐式信息以及显式信息的世界理解结果,形成一个智能驾驶系统的世界观,它代表一套价值——不能不顾下限,上限也要高。】

Ok 那这里又不一样上面是能有博弈能力,这里突然又是一个世界理解能力。 那到底是什么能力?

OK没关系,是两个能力,小孩子才做选择,成年人我都要。那你讲讲清楚啊。

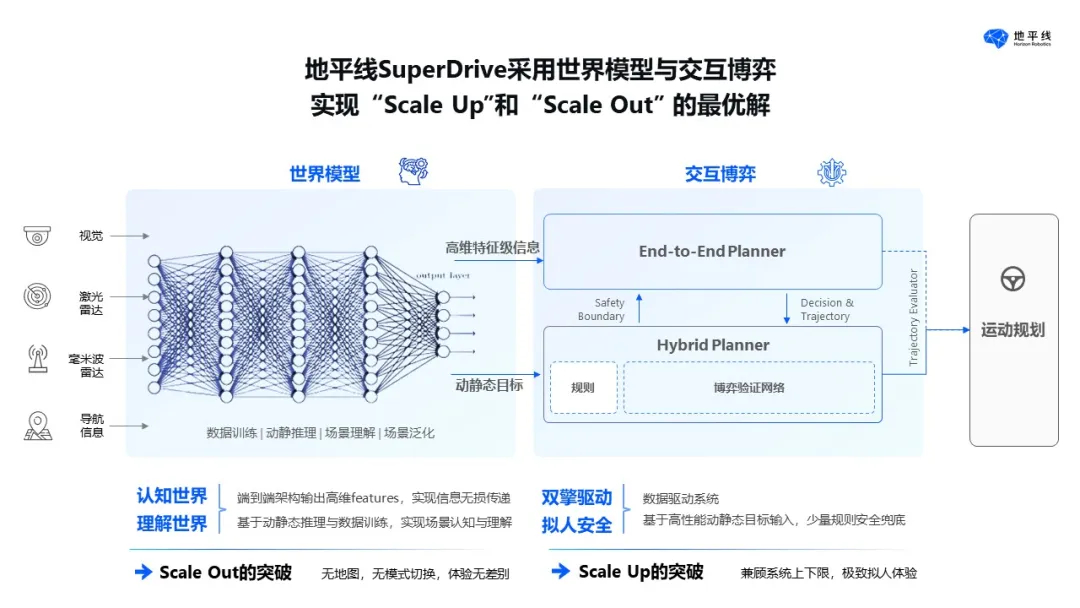

接下来是图一, 但是我们如果把世界模型这几个字换掉,换成感知模型,好像没有任何问题吧,那你是怎么做到世界模型保证下限的呢?还是一个感知网络啊。

世界模型,认知世界,理解世界,Scale Out,Scale up, 这些词汇真廉价又好听。

像是加多了鸡精的一碗白水。

最后黑字来强调整个系统的目标

【整个过程就像有个负责兜底、负责下限的人:他会持续地跟这个世界交互式推演心智模型,一方面假设这个世界充满多种可能性,所以会发送多个请求查询给到端到端的planner,让他帮忙推演未来会发生什么;另一方面又坚持自己的底线,在很多评估结论中,以安全、简洁、有原则的便捷来判定系统输出是否符合预期】

菜要上桌了,再补一把酱油吧,颜色更鲜亮。

推演心智模型,然后查询给端到端的planner,没问题啊,非常美好,但是这个架构图世界模型没有推演链路,也没有评估模块,到底是Hybrid Planner 在承担规则判定这个角色,还是世界模型?

从架构图应该是有一个Hybrid Planner 规则模块在做兜底,做规则判定,为什么不讲? 是觉得不够高级,非要用世界模型显得自己很先进?但是你的架构图又不是这么说的。

‘

还有最后一个问题:

基于神经网络的Planner + 一个规则模块作为兜底 + 一个大感知网络就这么不好意思拿出手来讲吗?

这也具有足够的进步,这也是工程师们夜以继日一步步做出来的,也是一点点接近目标的努力,我也相信能做出非常好的产品。

这个问题也丢给行业里面每一个宣发。

因为实际上,你们团队,大部分都是这样的方案。

你们有意无意在自欺欺人。