李彦宏AI大模型的内部演讲稿被曝光(全文)

Ai 大模型 百度 科技 aigc

仔细分析下,很多想不明白的地方一下子就通了!

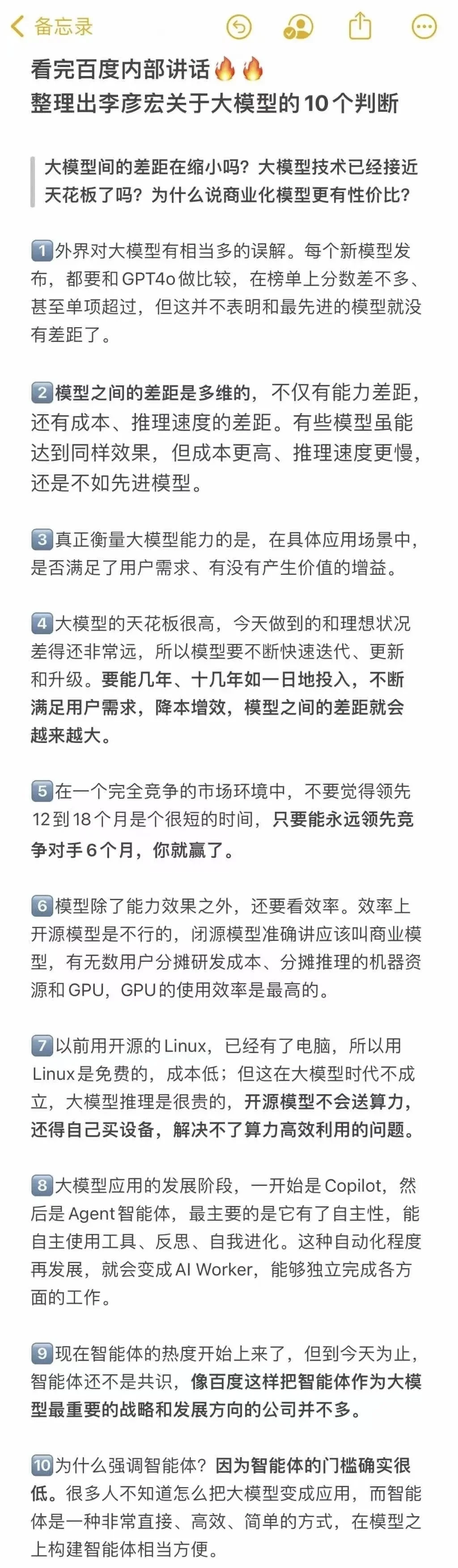

比如说,现在大模型像雨后春笋那么多,而且每个都说很厉害,甚至给人以“只要参数够多,就能超越GPT4”的错觉,难道大模型已经不存在壁垒了?

当然不是!李彦宏认为,说大模型不存在壁垒,这是一大误区。因为很多模型只是拿单项测试数据说事,反而忽视了大模型给用户的综合体验,随着大模型的不断迭代更新,不同的模型之间差距不是越来越小,而是会越来越大的。

不仅如此,还有人说开源模型正在缩小与闭源模型的差距,这会摧毁百度和OpenAI闭源大模型公司的商业模式。结果呢?其实这也是一个误区,李彦宏就表示,面对大规模部署和商业化运营时,开源模型的局限性便显现出来。

为啥这样说?

说白了,算力就是决定大模型的关键因素,而闭源模型是无数用户分摊研发成本、推理用的机器资源和GPU,能保证算力的充足供应,可开源大模型呢?又不给你送算力,效率自然跟不上——就像李彦宏说的,文心大模型每天调用量超过6亿,每天生成的token数超过万亿,开源模型推理成本怎么能够跟商业化模型相比呢?

热门分类