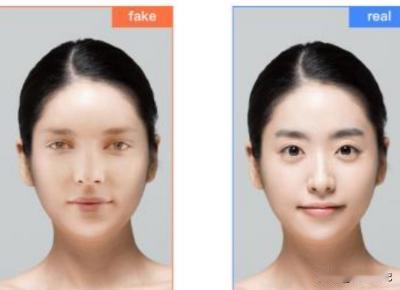

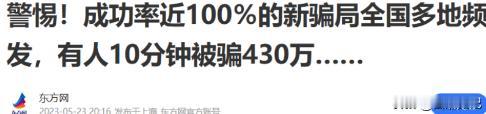

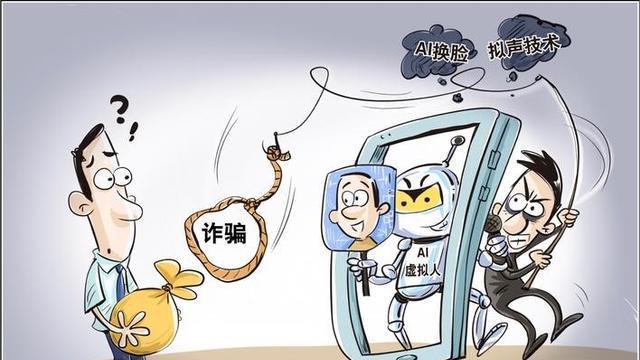

最新骗局来了!2023年4月20日,福州市一男子接收到了“好友”的视频,之后短短10分钟的时间,竟被“好友”骗走430万!男子遇上了“高端”骗局,对方通过智能AI换脸技术,佯装“好友”对其实施诈骗。而这个骗局成功率高达100%,并且在全国多地频发…… (信息来源:防范“AI换脸”诈骗 你需要的知识都在这儿了-央视网) 这年头骗子真是太可怕了,如今最新的AI骗局,基本上成功率高达100%,全国各地都有,让人不禁感叹骗子的进步真的是太快了,与之对应的我们也应该学会更多的防骗知识。 从长远来看,需要加强立法监管,对AI技术的使用和传播进行规范和限制,明确相关法律责任,打击利用AI技术进行违法犯罪的行为,才能从根本上遏制AI诈骗的蔓延。 AI这技术按理说应该给咱们带来好处的,但现在却被坏人利用了,这事儿不光是技术难题,还涉及到道德上的大问题。 我们需要共同努力,从立法、技术、社会教育等多方面入手,构建更加安全的网络环境,让科技真正服务于人类,而不是成为威胁。 2023年4月20号,福州一家科技公司的老板郭先生,在微信上被一个看起来像是朋友的人打来了视频电话,朋友在外地有个项目要投标,急缺430万保证金,想借用我们公司账户帮忙周转一下。 郭先生因为相信朋友,又通过视频确认了,没检查钱是否到账,就分两次把430万打过去了,十分钟后与好友本人联系才发现,自己掉入了AI换脸的陷阱。 警方迅速反应,最终止付336.84万元,但仍有93.16万元被转移,追回希望渺茫。 AI技术让换脸变得真假难分,就像古代传说中的画皮一样神奇,AI换脸技术,如同为骗子披上了一层画皮。 只需一张照片,就能生成高度逼真的动态视频,即使视频聊天也难以分辨真假,这使得传统的身份验证方式失效,让受害者深陷骗局而不自知。 除了在视觉上迷惑人,骗子现在还可能用AI技术模仿出目标人物的声音,通过收集目标人物的语音素材,AI可以合成以假乱真的声音,用于电话诈骗,进一步降低受害者的警惕性。 人脸信息收集,成了隐私泄露的“黑洞”,更令人担忧的是,人脸信息被肆意收集和滥用。 这些信息不仅被用于AI换脸诈骗,还可能被用于制作淫秽视频、进行敲诈勒索,对个人隐私和安全构成严重威胁。 浙江的虞某就是利用“AI换脸”软件,将收集到的人脸信息与淫秽视频合成,并在网络上进行传播和售卖,严重侵犯了他人的权益。 面对日益猖獗的AI诈骗,警方与银行联动,建立快速止付机制,一旦发现诈骗行为,立即启动止付程序,尽可能减少受害者的损失。 福州郭先生案中,警银联动止付了大部分被骗资金,就是这一机制的有效体现,然而止付并非万能,更重要的是提高自身的防范意识。 别随便发自己照片、视频啥的,网络转钱的时候也得特别小心点,跟亲友谈钱事儿时,最好用电话等方式确认一下对方是不是本人,如有疑问及时报警寻求帮助。 AI诈骗的出现,为我们敲响了警钟,科技是一把双刃剑,我们既要拥抱科技带来的便利,也要警惕科技被滥用带来的风险。 只有不断提升防范意识加强技术监管,才能在享受科技红利的同时,守护好自己的安全。