【正对着DeepSeek狂抄?Meta被曝整个AI部门深陷恐慌】当地时间1月23日,在美国匿名职场论坛TeamBlind上,一名Meta公司员工发布涉深度求索的帖子“Meta生成式人工智能部门陷入恐慌”,引起广泛讨论。

该员工在文中称,从深度求索发布DeepSeek-V3开始,就已经让Meta的Llama 4在各项测试中处于落后,“更糟糕的是,这家不知名中国公司仅为此花费了550万美元。”

550万美元是什么概念呢?“Meta生成式AI部门里的每位‘领导’的薪资都超过了这个数字”,该Meta员工称,“而我们却有几十位这样的领导,我根本无法想象该如何向公司高层证明部门目前高额成本的合理性。”

该员工透露,目前Meta的工程师们正在疯狂研究分析DeepSeek的成功,并试图从中复制任何能复制到的东西,这不是夸张。“然而,当DeepSeek-V1发布时,事情变得更加可怕了”,该员工表示虽然不能透露太具体,但有些事情很快将会公开。

最后,该员工反思称,Meta的生成式AI部门本应该是一个以工程为重点的小型组织,但因为很多人都想进来分一杯羹,人为膨胀了组织的规模,到最后人人都是输家。

目前不清楚该员工所指具体为何,是否暗示该公司生成式AI部门面临的调整或者其他情况的可能性,这还需要进一步观察,不过Meta在大模型中竞争中脚步放缓已是事实。

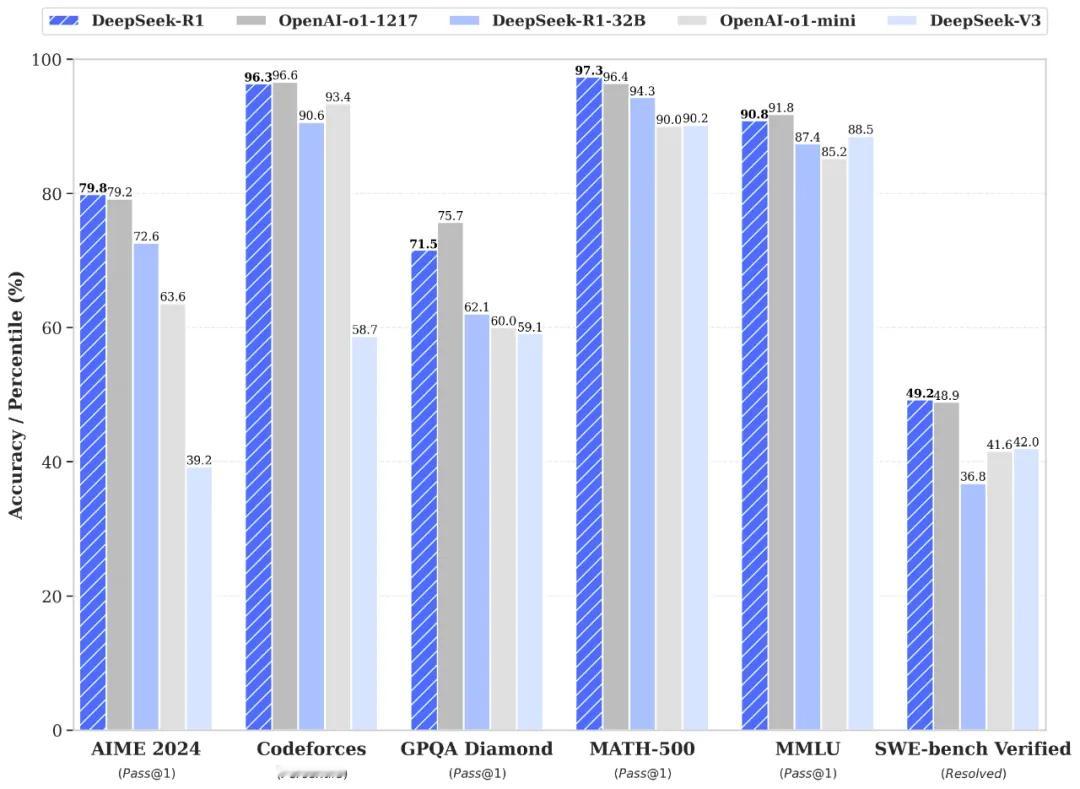

最重要的是,DeepSeek-V1以及深度求索同期提及的DeepSeek-V1-Zero模型,首次让整个行业清楚看到,大模型如何仅靠大规模强化学习(RL)驱动、在没有人类标注数据冷启动(SFT)的情况下,实现持续自我成长。

而在成本方面,深度求索虽然未透露DeepSeek-V1 的训练花费,但DeepSeek-v3的总训练时长则为278.8万GPU小时(其中预训练占266.4万小时),使用2048块英伟达H800 GPU,耗时约两个月完成。与之相比,同样开源的Llama 3.1-405B却消耗了3080万GPU小时,成本是DeepSeek-V3的11倍。甚至OpenAI公司的 GPT-4o的模型训练成本也达到1亿美元,这与DeepSeek-V3训练花费的557万美元相差巨大,也让“花小钱办大事”成为深度求索的重要标签。

对此,谷歌公司的一名员工评论称,深度求索很疯狂,不仅仅是Meta,面对这家中国公司时,OpenAI以及谷歌/Anthropic目前同样是“火烧屁股”。