【关于DeepSeek的十条谣言】

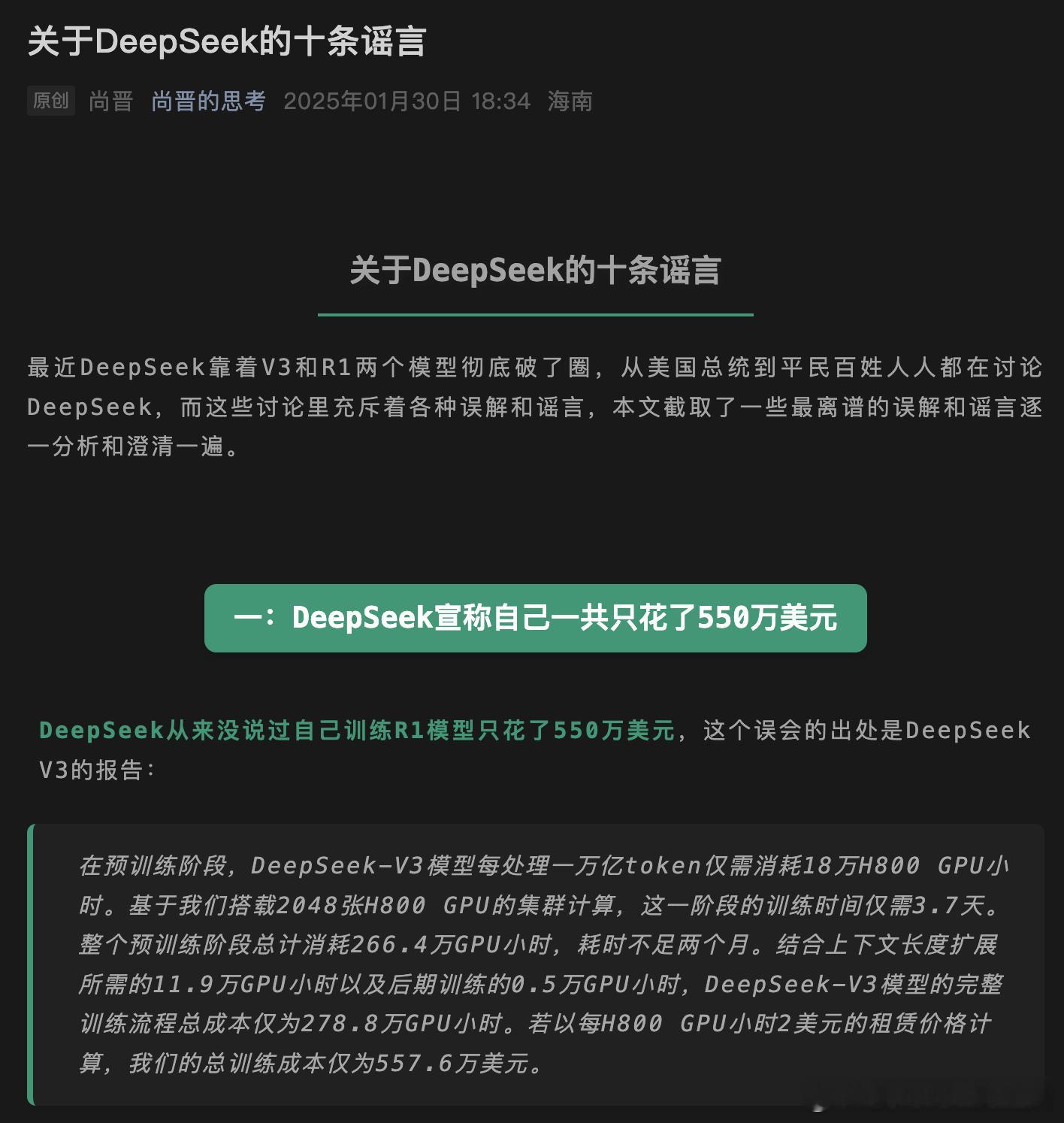

- DeepSeek训练成本: 驳斥了DeepSeek总成本仅为550万美元的说法,澄清该数字仅指V3模型最终训练阶段的成本,不包括人员薪资、硬件和数据准备等其他大量支出。

- DeepSeek的GPU数量: 驳斥了DeepSeek拥有5万张H100 GPU的谣言,将其归因于可能带有偏见的报道和竞争利益。实际数量估计约为1万张,主要为A100和H800 GPU。

- DeepSeek与OpenAI的关系: 回应了DeepSeek仅仅是OpenAI模型的“山寨版”的误解。虽然承认由于互联网范围的数据收集和使用GPT生成合成数据导致训练数据存在一些重叠,但它强调了DeepSeek的开源性质以及R1与OpenAI模型之间的显著差异,尤其是在推理能力方面。

- DeepSeek的模型大小和数据: 澄清DeepSeek V3/R1是一个大型的6710亿参数模型,使用14TB的数据进行训练,这与它是小型模型、使用小型数据集训练的说法相矛盾。这指出了由于关注模型的较小、蒸馏版本而可能产生的误解。

- DeepSeek的开发时间线和商业策略: 驳斥了DeepSeek是一个最近才创建、仓促完成的、旨在追求经济利益的项目的观点。它强调了DeepSeek在开源AI社区中持续存在以及其对AGI研究的长期承诺,而不是追求眼前的盈利。

- DeepSeek的产品可用性: 区分了模型的能力及其配套应用的质量。它承认该应用的用户体验存在不足,同时强调这些不足与底层模型的性能无关。

- 中国在AI领域的地位: 反驳了中国在AI方面远远落后于美国的简单化说法。它强调了中国在开源AI领域强大的存在,列举了来自不同公司的具有竞争力的模型的例子。

- DeepSeek的成就: 准确地将DeepSeek的成就定位为通过创新技术和高效资源利用实现的重大进步,而不是完全超越OpenAI。

思考:

- 信息传播的复杂性与重要性:谣言的传播速度之快令人警醒,需要提高信息鉴别能力,避免被误导。

- 技术发展与商业宣传的平衡:技术实力与市场宣传应保持平衡,避免过度炒作或贬低,才能促进健康发展。

- 中美AI竞争的客观认识:避免简单化地看待中美AI竞争,应客观认识各自优势和差距,才能更好地促进技术进步。

mp.weixin.qq.com/s/Zwm8-ZdxtSq9cQwR5LA_zA