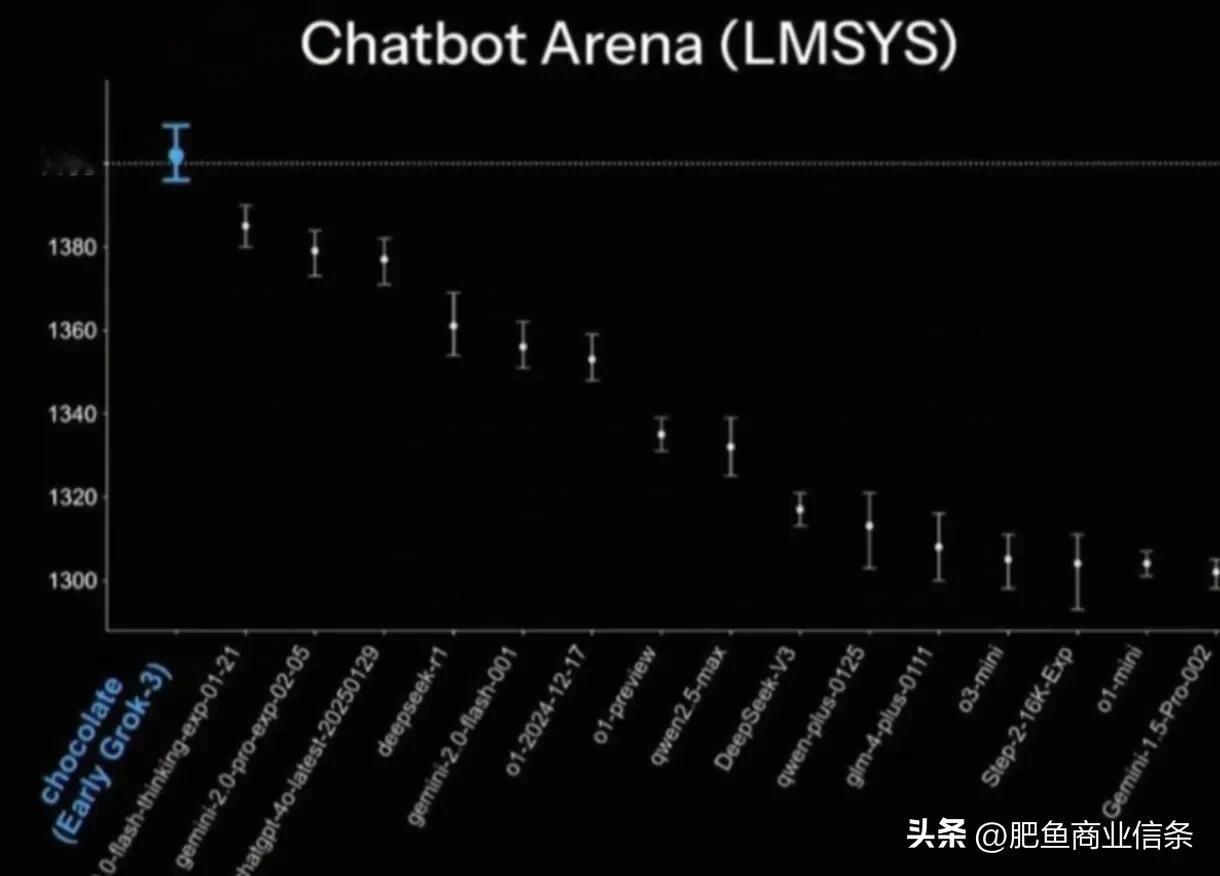

检验Scaling Law的时候到了! 马斯克官宣Grok3

人类首个10万张卡训练的大模型Grok3,即将在美国时间周一晚八点,也就是我们的周二中午12点~

Grok 3的训练使用了10万个Nvidia H100 GPU,相较于前代Grok 2的15,000个GPU,计算能力提升了数倍。

每个H100 GPU的功耗约为700瓦,因此10万个GPU的总功耗可能达到70兆瓦,相当于一个小城市的用电量。

我之前调过Grok2的API测试,token出得比较快,我还试了下它对特斯拉知识的熟练程度如何,结果连胎压都搞不清楚,估计并没针对特斯拉的数据做训练。。。

美C

马斯克钱多不计成本,这个牛人,以后手机通话不用电话卡,一心想干掉电信营运商!