DeepSeek让全球拥抱开源免费,戳破美国AI泡沫,美国会不会强行收购,或者迫使其闭源?把屠龙少年变成恶龙,让梁总活成自己讨厌的样子吗?这不就是无能狂怒吗?

其实,美国还真拿DeepSeek没办法,就像意大利要求它提供数据保护相关信息,频发公开信,催促它回应。但DeepSeek都懒得看它一眼:爱用用,不用就滚!

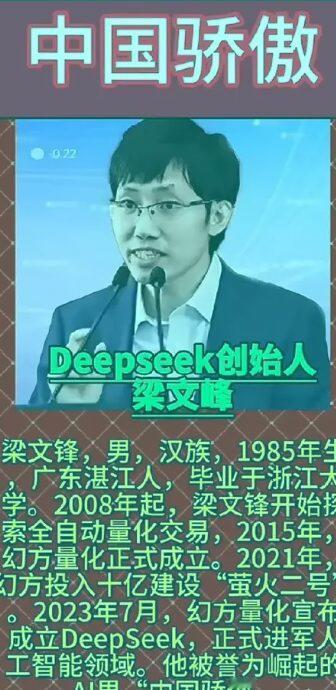

DeepSeek属于幻化量方,主业是金融,AI纯属副业。公司在杭州汇金国际,海外无实体,美国能奈它何?难道登陆杭州湾,派美国大兵去抢?

另外,DeepSeek已经把预训练权重、细节和参数等都公开发布。只要你有足够算力,按照操作手册去实施,都可以做出相同的AI大模型,压根就不需要花钱。

所以,咋收购嘛!从DeepSeek把算法昭告天下那一刻起,就意味着全世界将诞生无数DeepSeek,豪华版、尊享版、乞丐版,丰俭由人。

DeepSeek就像长江冲出夔门,美国即使叠礁如三峡电站,也无法阻挡长江浩荡东流。开源免费就像金沙水拍,穿山裂石自成航道,美国硅谷纵有百艘航母列阵,也阻挡不了水流归海入洋。

在美国剧本中,全球AI赛道必须由美国引领和垄断。算力芯片用英伟达,AI大模型用OpenAI,算法算力必须由美国垄断。总之,越是高级的东西越是需要大投入,只有花大价钱才能得到高性能AI模型。

能耗方面,谷歌、openAI和微软等都在购买核电站,用以支撑训练大模型所需电力,为啥?一是美国电力系统不稳定,成本太高;二是美国电力公司也需要讲故事抬股价;三是美国核聚变研发需要圈钱。

算力方面,英伟达可以讲故事抬股价,甚至暴利垄断。2020年,英伟达净利润率为26%,2021年36%、2022年16%、2023年49%、2024年高达56%,搞得全世界都怨声载道。

算法方面,openAI在公布GPT之后,立马原地起飞。2024年下半年,有无数小道消息说openAI要上市,估值至少几千亿美元,甚至有望成为“美股七朵金花”之后的第八朵花。

应用方面,一旦美国炼成AI吸星大法,美国人工智能技术就将成为全球标准,其他国家就必须采用美国标准,加入“星际之门”,接入openAI大模型,采购英伟达芯片,给美国交保护费。

其实,这玩意最大的应用市场在中国,这就意味着中国必须花大价钱购买美国先进AI,啥?买芯片自己做?老黄届时会把镰刀高高举起。总之,AI就是让美国再次伟大的神器,只此一家,收割全球。

众所周知,AI有三大支柱:一是算力和基础设施,二是算法和人才队伍,三是数据和应用场景。美国强在算法和算力,中国强在数据和应用场景。

但DeepSeek横空出世,瞬间抹平了中美在算法和算力上的差距。在算力芯片被制裁的情况下,DeepSeek综合性能依然不输GPT,充分说明DeepSeek算法比GPT强大,可以通过算法来弥补算力不足。

在最近召开的巴黎人工智能行动峰会上,DeepSeek现场展示了用千卡集群训练出来的万亿参数模型,能耗仅为GPT-7的1/7,成本仅为GPT的1/20。

花小钱办大事,这就让美国很难绷,高大上的牛逼故事没法讲,那些成百上千亿美元的账就没法平。美股哀嚎一片,买核电站的谎话都不知道咋圆回去,预算5000亿美元的众筹项目——“星际之门”也被尬住了,心塞!

在闭源策略失败后,OpenAI也随之跌落神坛,说好的几千亿美元的上市估值也成为梦幻泡影。然后,马老板就扬言要以974亿美元收购OpenAI。目前,奥特曼委婉回绝了马老板。

但从马老板现在的身份,以及之前收购推特的经历来看,OpenAI不一定能逃出他的手掌心,毕竟马老板背后还有懂王。不客气的说,OpenAI即使不卖给马老板,至少也要让MAGA派参股,甚至控股。

相比于华为、大疆和TikTok这些中企,DeepSeek可能是美国所遇到的最强劲的对手。它就是个100多人的小公司,却可以坐在杭州办公室联动世界。华为、大疆进出美国得经过海关,看得见摸得着,美国一旦禁售,它们也没啥好办法。

TT之所以跟美国纠缠拉扯,主要是不想撕破脸。其实,TT完全可以去其他国家开分公司,照样做美国生意。哪怕苹果应用中心下架TT,TT也可以教用户通过第三方下载。哪怕美国修防火墙,TT也可以开发翻墙软件,手把手教美国老铁翻墙。

相比TT,DeepSeek更难对付,它破解了“修昔底德陷阱”,通过免费开源实现星辰互联,解构美国零和博弈思维。它重构技术哲学,用“数字天下观”破解美国“技术殖民主义”。

对所有国家和个人而言,只要不想被收割和被殖民,就必然会拥抱DeepSeek。所以,并非DeepSeek需要美国用户,而是美国用户需要它,它只要保持自身技术领先和好用就行。

如果美国政府硬要强行加戏,DeepSeek完全可以对着美国政府,双手一摊:爱用用,不用就滚!

Anspor

“在最近召开的巴黎人工智能行动峰会上,DeepSeek现场展示了用千卡集群训练出来的万亿参数模型,能耗仅为GPT-7的1/7,成本仅为GPT的1/20。”有吗,任何峰会的相关新闻都没有找到这段所谓的演示,自媒体也不能随便胡扯啊?