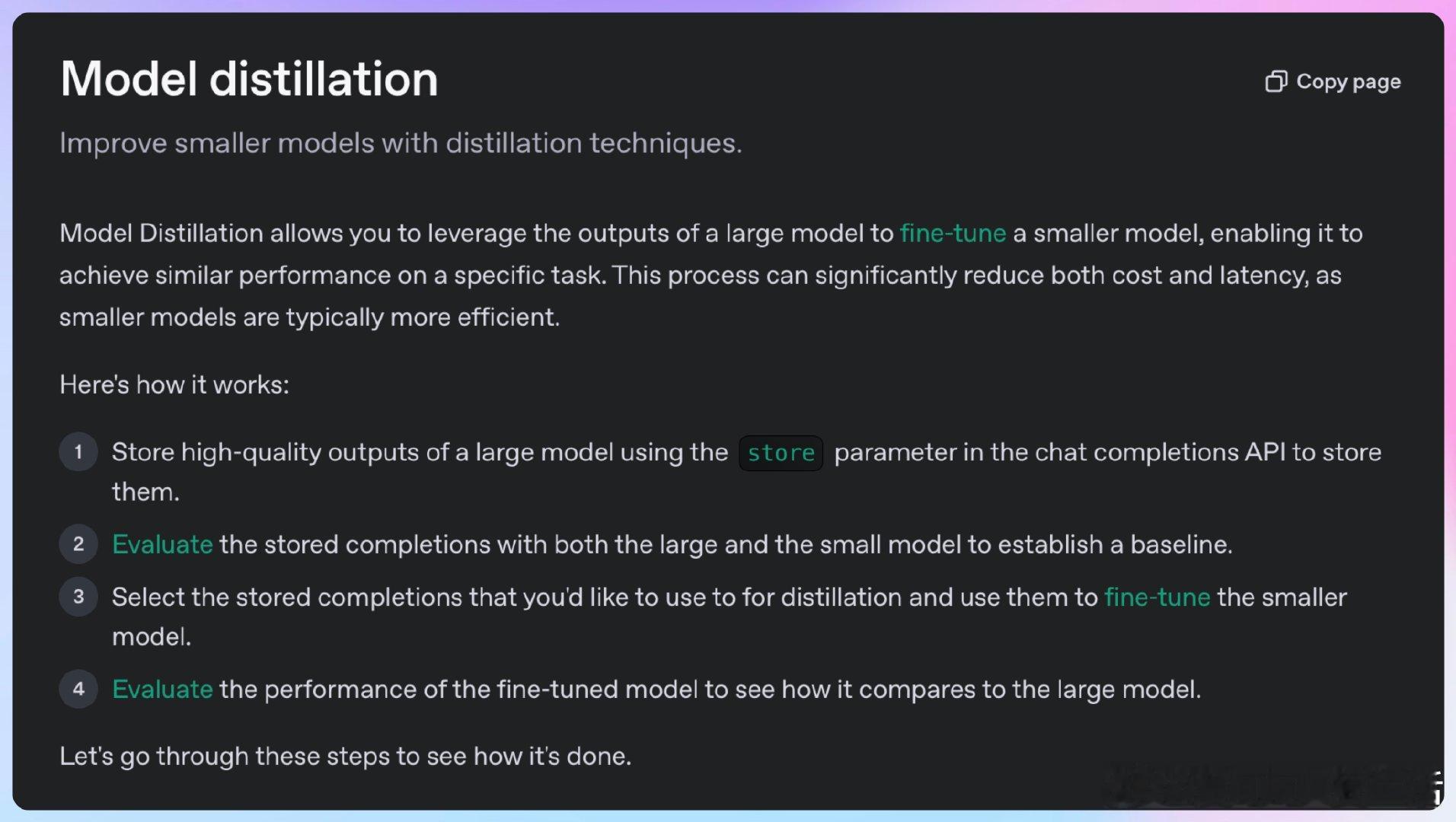

【Model Distillation:OpenAI官方的模型蒸馏指南。模型蒸馏是一种提升小型模型性能的技术,通过利用大型模型的输出来对小型模型进行微调,从而在特定任务上实现与大型模型相似的性能,同时降低成本和延迟。亮点:1. 通过大模型的输出来微调小模型,性能提升显著;2. 小模型效率更高,成本降低可达数倍;3. 简单几步即可完成模型蒸馏,操作便捷】

'Model Distillation allows you to leverage the outputs of a large model to fine-tune a smaller model, enabling it to achieve similar performance on a specific task.'