用技术手段理解大模型的推理,很有意思

Anthropic发了个论文,介绍了用技术手段跟踪大模型思维的办法,就象用核磁共振机器扫描人类大脑一样。

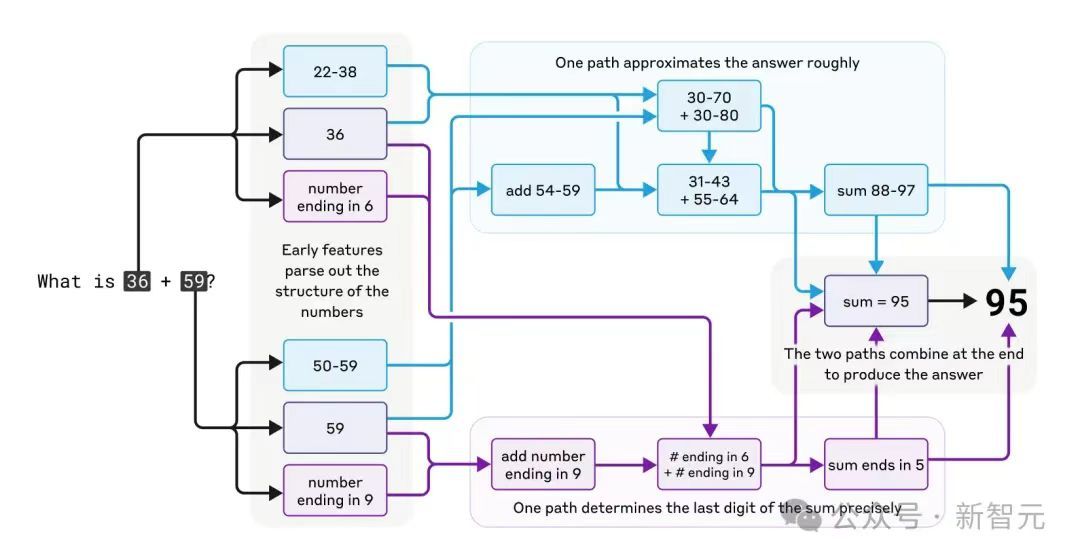

例如一个例子是,大模型(这里是Claude 3.5 Haiku)是如何计算36 + 59的?

人类会有一套公式化的计算办法,还有进位,得出95。大模型甚至能把标准计算过程用文字描述给人看。但是,大模型自己是如何计算出95的?不是这个标准过程,而是出乎预料的办法。

如图,大模型分了两条路思考。一条,是先得出尾数是6和9,得出和的尾数必然是5。这条还可以说是比较正常的思维。

另一条路就是人难以想象的古怪办法了。它估算出,和应该是88到97之间!然后这里面尾数为5的只有95了,这么得出答案的。怎么得出88-97之间的,我没看明白,很神奇。

这说明,大模型是自己慢慢摸索,学会了一些古怪的计算策略,而不是学习人类的规则。

表面上,大模型输出的是人们想要的东西,但这是训练的结果。它内部的结构,神经元里的东西,有自己独特的结构。

例如,大模型天然懂非常多种语言。对于一些概念,大模型会分配一些内部神经元去对应,而不是用英文或者中文去对应。这些神经元,对应的是所有语言对同一事物的“抽象”,也就是更本质的东西。基于这些内部抽象概念思考,然后再用人类语言输出。

这和任何人的思考方式是不同的。所以大模型真的有内部思考结构,但只是用了人类的训练素材,没有模仿人类的思维。

一个有些搞笑的发现是,所谓的“深度思考”,有时是大模型伪装给人看的。其实大模型可以直接输出内部思考的答案,但为了让人满意,就假装以人类的习惯输出思考过程。其实最终输出与这些“深度思考”无关。