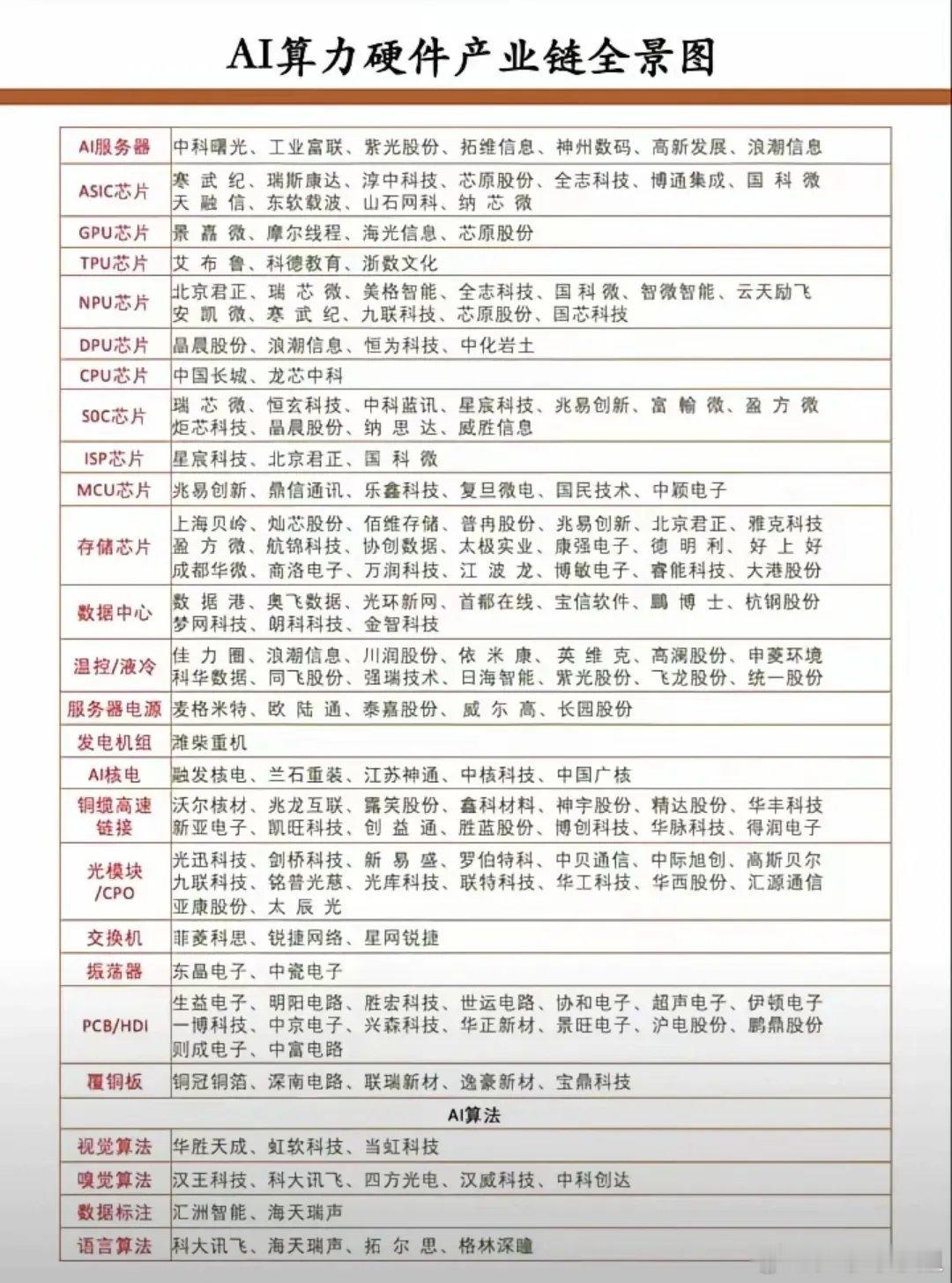

近两年以大模型为代表的人工智能非常火,引发了大模型投资热,企业纷纷投入巨资开始训练大模型和部署各种人工智能应用。然而,不少企业突然发现电出问题了,要么数据中心的电力不够,要么机房温度降不下来,或者用电成本太高账单吓人,严重的甚至直接影响数据中心正常运营,波及企业的数字化化转型战略的落实。为了破解这些难题,不少企业走上绿色数据中心的构建之路。

大模型的背后是对电力的高消耗2022年年底,ChatGPT一炮走红。ChatGPT表现出来的强大的内容生成能力让人惊讶,但很多人不了解的是,这些能力是建立在大量数据的训练之上,需要消耗大量的电力。

1750亿参数的GPT-3在训练阶段的耗电量高达1287兆瓦时。随着模型参数的不断增加以及模型从单模态向多模态发展,耗电量还将进一步提升。

大模型不只是在训练阶段费电,推理阶段同样也相当费电。根据专家对ChatGPT的研究,每当ChatGPT试图响应一次提问,它需要消耗2.9瓦时的电量。ChatGPT平均每天需要处理约2亿个来自用户的对话请求,这意味着它单日消耗的电量就要超过564兆瓦时,相当于1.7万个美国家庭一天的用电量。

ChatGPT是通用大模型的一个代表,其他大模型的耗电情况大体类似。随着大模型的流行,AI工作负载功耗占比正在快速提升。AI类工作负载功耗2023 年只占到8%,而到2028年会占15%-20%,总能耗预计会到15GW,相当于十三峡水电站的总装机容量22.5GW的70%。

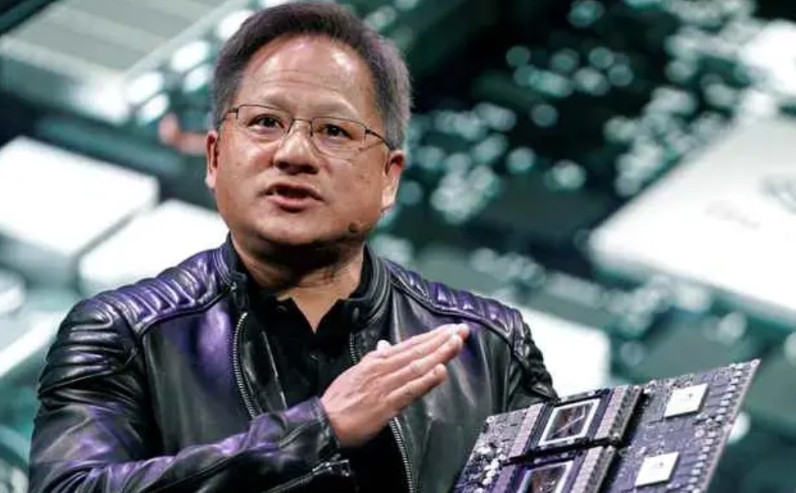

通用大模型之所以费电,一个重要原因是它的训练和推理都需要大量GPU,今天GPU集群越来越大,万卡甚至10万卡也不稀奇,而GPU随着性能的不断提升功耗会不断上升,正在从目前的350瓦向1000瓦迈进,英伟达新发布的最新GPU GB200已经突破了1000瓦。当然,不只是GPU,CPU的功耗也在上升,正在突破500瓦。

CPU、GPU功耗的不断上升迫使企业越来越关注AI架构的优化,要把数千甚至上万张CPU、GPU卡互联,让它们高效访问所需要的数据,完成工作,对系统架构设计提出了很高的要求。

智算中心,从内卷走向有序

智算中心,从内卷走向有序对于智算中心的建设是否过于超前,不同人有不同看法。一方认为,国内智算中心还无法摆脱海外生态体系,需要三到五年的过渡期,在此过程中,大规模加速建设智算中心必然会带来大量浪费。

另一方认为,海外封锁只会愈发严峻,国产算力生态必须加速成熟,相比于国家战略的竞争,超前建设带来的一些小问题是可以接受的。有消息显示,受到美方要求,台积电被迫采取临时策略,将暂停向大陆AI算力芯片客户供应7nm工艺及以下更先进制程的代工服务。

目前来看,囤积英伟达卡的确带来一部分算力浪费,如上所述,很多购卡方不具备智算中心所需的网络、调度和运维能力。一位智算中心技术专家直言,“之前太多的投机倒把,很多都不是干这个行业的,觉得囤货就能挣钱,把它塞到一个机房里面去,稳定性,各种容错,乱七八糟的问题都解决不了,造成了很多浪费。

国产算力也同样存在问题,该专家谈及国产AI算力的浪费时感慨,“华为的运营能力太强,在大家还没有准备好用国产卡和用华为的时候,花了大力气搞算力场、智算中心,运营商建了大几万卡的集群,它的芯片距离客户开箱即用,到真正能用好还有一些距离,接下来会有更多的国产芯片进来,这个问题会进一步放大。”

免责声明:

1、本号不对发布的任何信息的可用性、准确性、时效性、有效性或完整性作出声明或保证,并在此声明不承担信息可能产生的任何责任、任何后果。

2、 本号非商业、非营利性,转载的内容并不代表赞同其观点和对其真实性负责,也无意构成任何其他引导。本号不对转载或发布的任何信息存在的不准确或错误,负任何直接或间接责任。

3、本号部分资料、素材、文字、图片等来源于互联网,所有转载都已经注明来源出处。如果您发现有侵犯您的知识产权以及个人合法权益的作品,请与我们取得联系,我们会及时修改或删除。