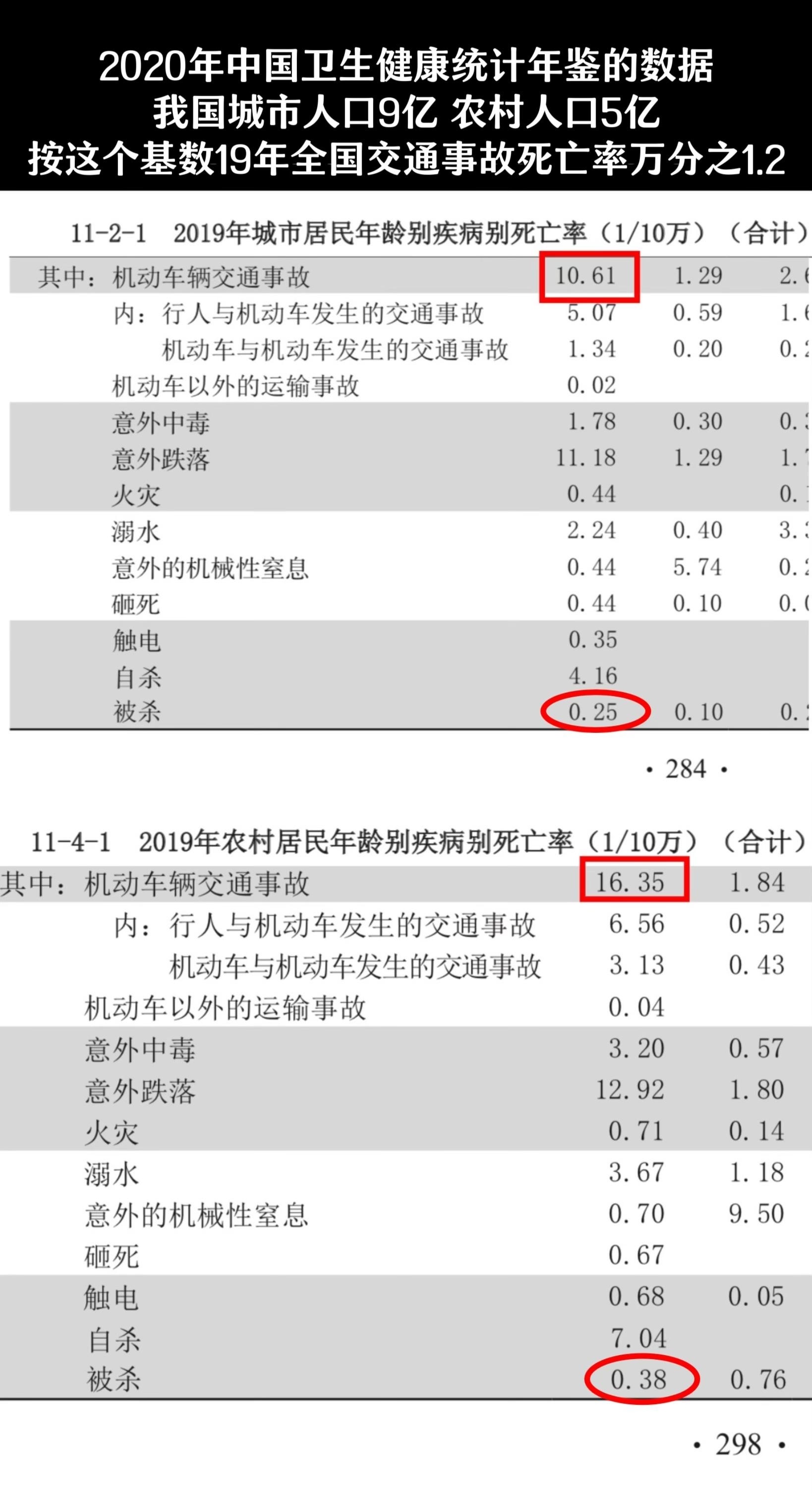

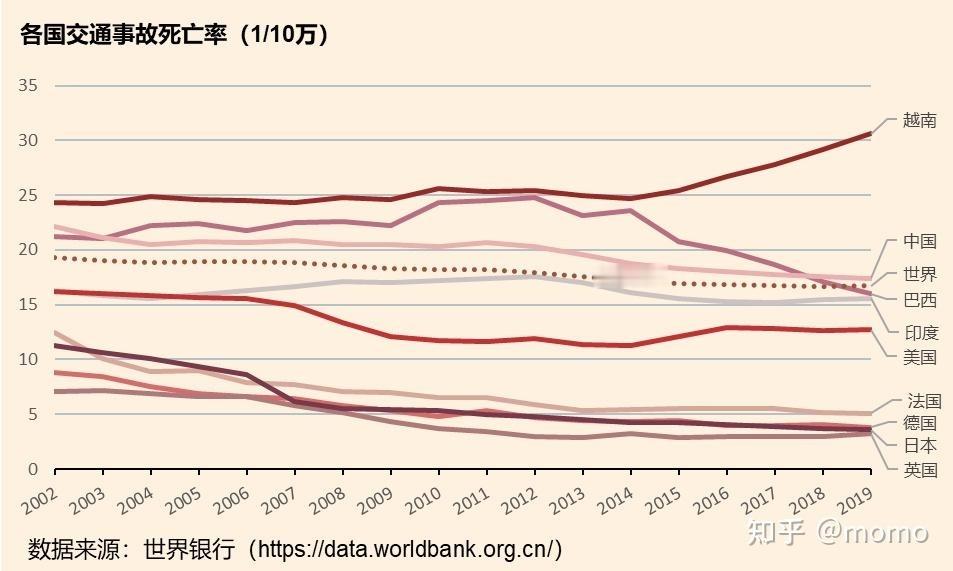

以人类平均事故率看,约为10-20 死亡人数/ 每十万人,不同的地区,或者不同的统计口径有不同的结果,但是大致数字如此。

假设某个公司以数据驱动的方式学习人类的驾驶习惯,事故率接近了这个数据,也就是说使用该自动驾驶系统的死亡率是万分之一。

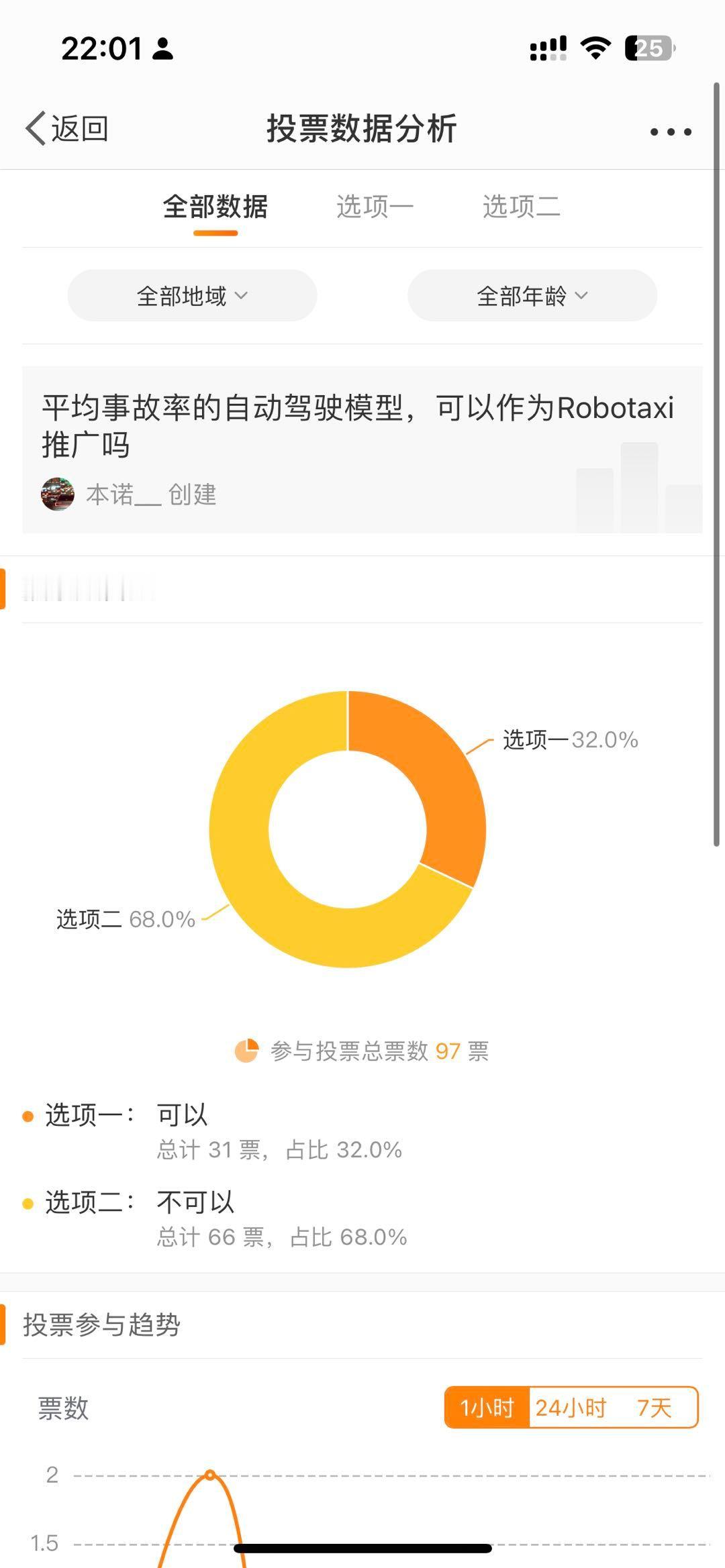

从保险的角度看,似乎已经可以跑通整个商业逻辑,但是对于某个公司的系统,或者对公众售卖的机器,我们是否能够有这么高的容忍度?

从今天发的投票(图三)看,确实,大家对此并不买账

Cruise 被责令关停,是一次非自己相关的交通事故,而是对受害者产生了二次伤害。

这也是很多L4 公司批评特斯拉的原因,认为端到端永远无法满足RoboTaxi 对于安全的要求,因为人类的习惯已经锁死了系统的上限。

前两天的Tesla 的发布会,大部分从业者都在等待马斯克对安全上限的问题做出回答,可惜他并没有提到。

但是换个角度看,如果一个L2 的系统真的接近如此的事故率,那么由人去完成最后的兜底,辅助保险策略,会是一个极其成功的系统。