小鹏 XNGP 图灵智驾系统分析

摘自facetop facetop智能座舱

小鹏图灵Navigation Guided Pilot(XNGP)具备全场景智能辅助驾驶能力,能在高速、城市道路等各类路况下,完成诸如车道居中、红绿灯启停、超车、规避障碍物等丰富操作。依靠强大硬件,如双NVIDIA DRIVE Orin芯片、多种摄像头与雷达,搭配先进的XNET感知架构及端到端大模型,极大提升感知、预判与决策执行能力,为用户带来了实用的智驾体验。

2019-2021年,小鹏搭建起智驾基础,推出L2级自动泊车与高速自驾功能。2022年,凭借XNGP系统的发布,小鹏引入BEV+Transformer架构,全方位升级软硬件。2024-2025年,小鹏凭借端到端大模型,让智驾系统功能覆盖小路、内部路等复杂场景。

传感器方面,起初是摄像头、毫米波雷达和超声波雷达融合,部分车型搭载激光雷达;2025年部分车型取消激光雷达,采用纯视觉方案,通过提升摄像头性能及算法来保障智驾功能 。

扶摇架构

CONTENT

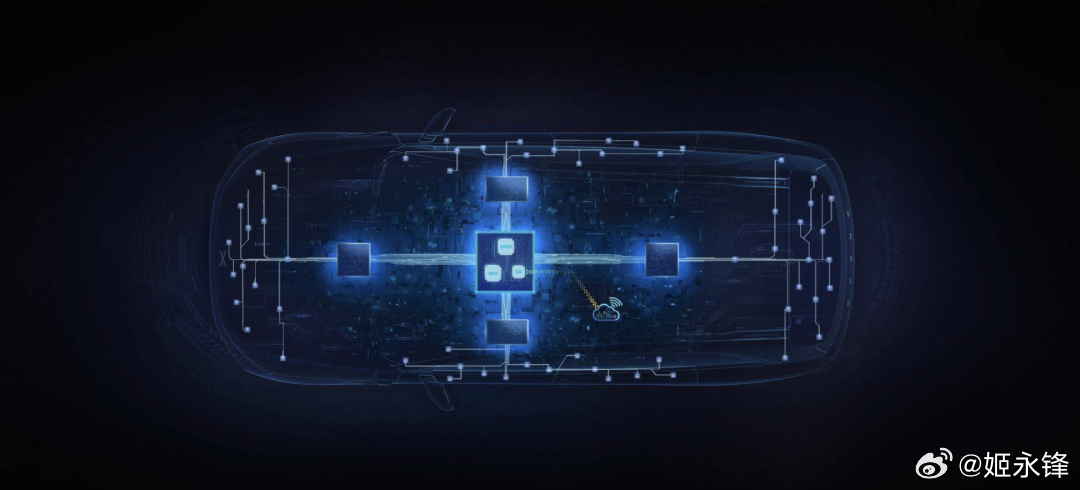

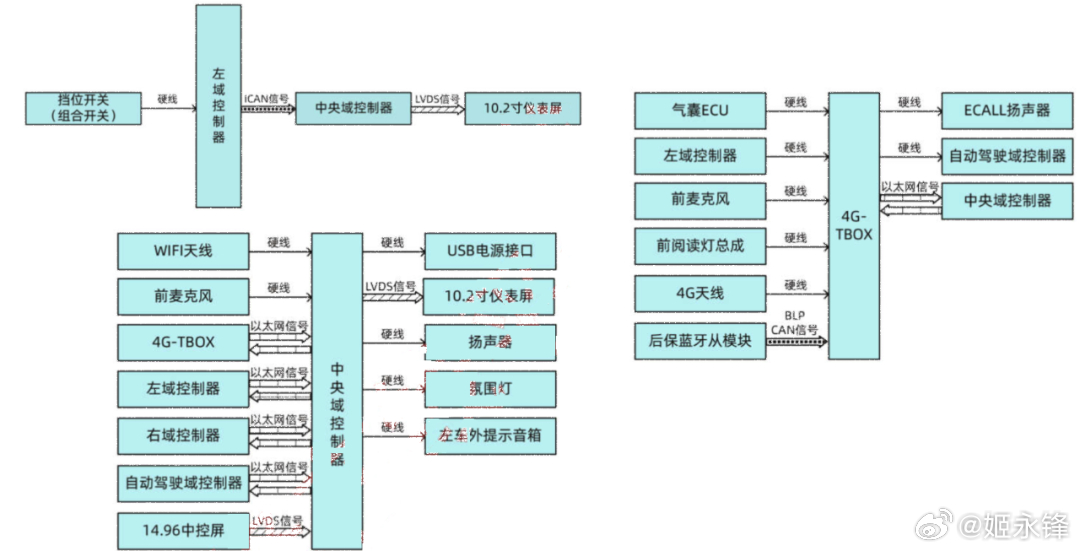

小鹏“扶摇”架构SEPA2.0全域智能进化架构,涵盖动力补能、智能体系、整车制造三方面。其中X-EEA 3.0电子电气架构作为智能体系重要部分,采用“中央超算+区域控制”的架构,具备强大的算力和高速的通信能力,为XNGP智能辅助驾驶系统和XOS天玑系统提供硬件支持,确保数据的快速传输和处理。

智驾功能由单独的「小鹏自动驾驶处理单元X-PILOT Processing Unit」(XPU)负责。

中央超算在信息传输与调度环节,对整车网络通信进行集中管理。一方面,它汇总来自区域控制器、XPU及其他功能模块的数据;另一方面,它依据车辆的运行逻辑,对各模块的通信优先级进行合理调配,确保关键数据的及时传输。同时,中央超算负责仪表显示、中控和副驾信息娱乐功能,以及跨域融合功能,如车外声音控制、外部灯语控制、氛围灯控制和泊车辅助灯等。

XPU承担智能驾驶相关的运算和控制任务,对来自激光雷达、摄像头、毫米波雷达等传感器的数据进行处理。通过构建车辆周边的3D环境模型,开展环境感知、路径规划、决策控制等工作。

XPU与中央超算之间通过高速以太网(如1000Base-T1)进行通信,中央超算接收XPU的数据后,结合车控和座舱状态,进行综合决策,并向车辆的执行器(如制动系统、转向系统等)发送控制指令。例如,当「智驾系统」检测到前方有障碍物需要避让时,XPU会将这一信息传递给中央超算单元,中央超算单元向「车控域」传达转向和动力系统指令,让其范围内的「区域控制器」通过精确计算转向角度、调整动力输出,来实现避让动作 。

XNGP硬件

CONTENT

小鹏图灵AI智驾采用纯视觉方案,取消了激光雷达,依靠摄像头作为主要的环境感知设备;配备双英伟达Orin-X芯片,提供高达508TOPS的算力。

以小鹏G6和G9为例:

12个摄像头

2个前目摄像头:对前方道路、车辆、行人、交通标志和信号灯等进行识别和监测;

1个后视摄像头:在倒车时提供后方视野;也可用于监测后方来车等情况,为变道、并线等操作提供参考;

4个侧视摄像头:帮助车辆进行侧方碰撞预警、自动变道辅助等功能;

4个环视摄像头:提供车辆周围 360 度的全景视觉信息,为泊车、低速行驶提供视图;

1个DMS摄像头:监测驾驶员的状态,以判断驾驶员的疲劳程度、注意力集中程度。

小鹏AI鹰眼智驾方案采用行业首发单像素Lofic架构,可以让摄像头在逆光、大光差、暗光等环境下的信息采集能力更强,视觉感知范围达到1.8个标准足球场,能够清晰分辨颜色、文字等语义信息。

3个毫米波雷达

1个前毫米波雷达:实时监测前方车辆、行人、障碍物等的距离、速度和角度信息;

2个角毫米波雷达:侧重于监测车辆侧前方和侧方的区域。

12个超声波雷达

帮助驾驶员准确判断车辆与周边障碍物的位置关系,避免碰撞,实现安全泊车。

XNGP端到端大模型

CONTENT

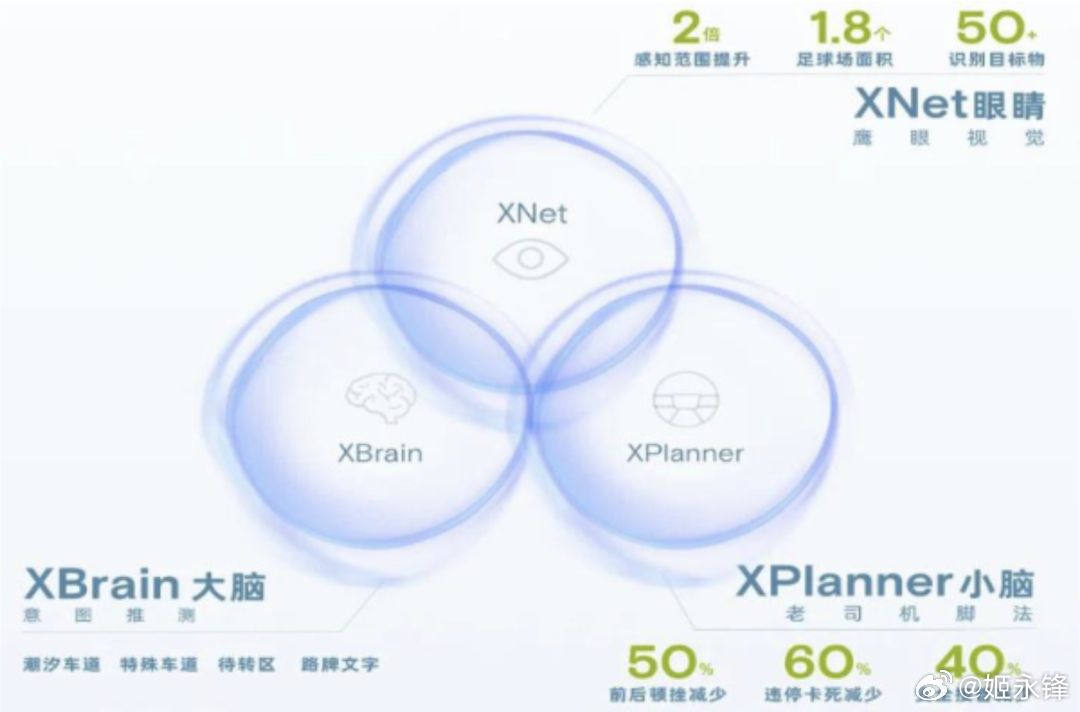

神经网络XNet

融合动态、静态XNet及2K级占有网络,赋予自动驾驶系统裸眼3D能力,可逼真还原可通行空间。感知范围提升2倍,达1.8个足球场大小,能精准识别超50种目标物,为智能决策提供视觉基础。

动作:神经网络XNet通过多个网络融合,像3D裸眼一样感知车辆周边环境,大幅提升感知范围,精准识别各类目标物,并传递这些环境信息。

大语言模型XBrain架构

使自动驾驶系统拥有大脑的理解力、学习能力。面对复杂、未知场景不犯难,增强对路况、路牌的识别,快速理解指令,做出安全高效的拟人驾驶决策。

动作:大语言模型XBrain接收XNet传来的信息,理解复杂路况、路牌含义,推理场景逻辑,明确该做什么决策。

规控大模型XPlanner

类似人类小脑,经海量数据训练,驾驶策略拟人化。能让前后顿挫减50%,遇违停卡死概率降低40%,安全接管次数减少60%,提升驾驶舒适与安全性。

动作:规控大模型XPlanner依据XBrain的决策,结合XNet感知数据,像老司机那样规划行车路径,控制车速、跟车距离等,让车辆安全舒适行驶。

云端大模型如何

影响车端大模型

CONTENT

知识蒸馏传输

云端大模型将学习到的知识、经验和优化后的参数,通过知识蒸馏的方式,传递给车端大模型。这使得车端模型能够借鉴云端的训练成果,快速提升自身性能。

突破车端算力限制

车端硬件算力存在一定局限性,难以支持超大规模模型的训练。云端大模型拥有强大的算力和海量数据处理能力,参数量多达车端参数量的80倍 ,可吸纳更多智驾数据,覆盖更多驾驶场景,再将训练好的优化模型部署到车端,提升车端模型上限。

数据闭环优化

车端收集的数据经清洁、挖掘后传输到云端,云端大模型基于这些数据训练优化,再把优化后的成果反馈到车端,形成数据闭环。持续的迭代优化,让车端大模型不断适应新场景、新问题,性能逐步提升。

功能体验

CONTENT

AI代驾功能

基于AI自主学习,手动驾驶一遍路线,系统24小时内生成定制路线,能模仿用户变道风格、车道选择等驾驶习惯;可储存10条记忆路线,每条最长100km,覆盖小路、能应对掉头等复杂场景,满足通勤、郊游、出差等出行需求。

AI代驾的技术支持

用户手动驾驶过程中,系统采集路况、驾驶习惯等数据传输至云端,端到端大模型中的神经网络XNet同步处理视觉数据。到达目的地保存路线,云端大模型结合规控大模型XPlanner和大语言模型XBrain分析挖掘数据,优化驾驶策略,学习用户风格,24小时内完成路线创建。使用时,选定线路开启导航,在可用范围拨杆激活,车端大模型依据云端成果和自身经验控制车辆,提供定制化智驾体验。

AI代驾与XNGP的共性和区别

本质上AI代驾与XNGP都是用户的AI司机,都采用端到端大模型技术来感知、分析和执行。

XNGP可看作是所有用户共同训练的AI司机,为用户提供通用的辅助驾驶;而AI代驾是每个用户单独训练的AI司机,能学习和模仿用户的驾驶习惯与风格,实现个性化的辅助驾驶。

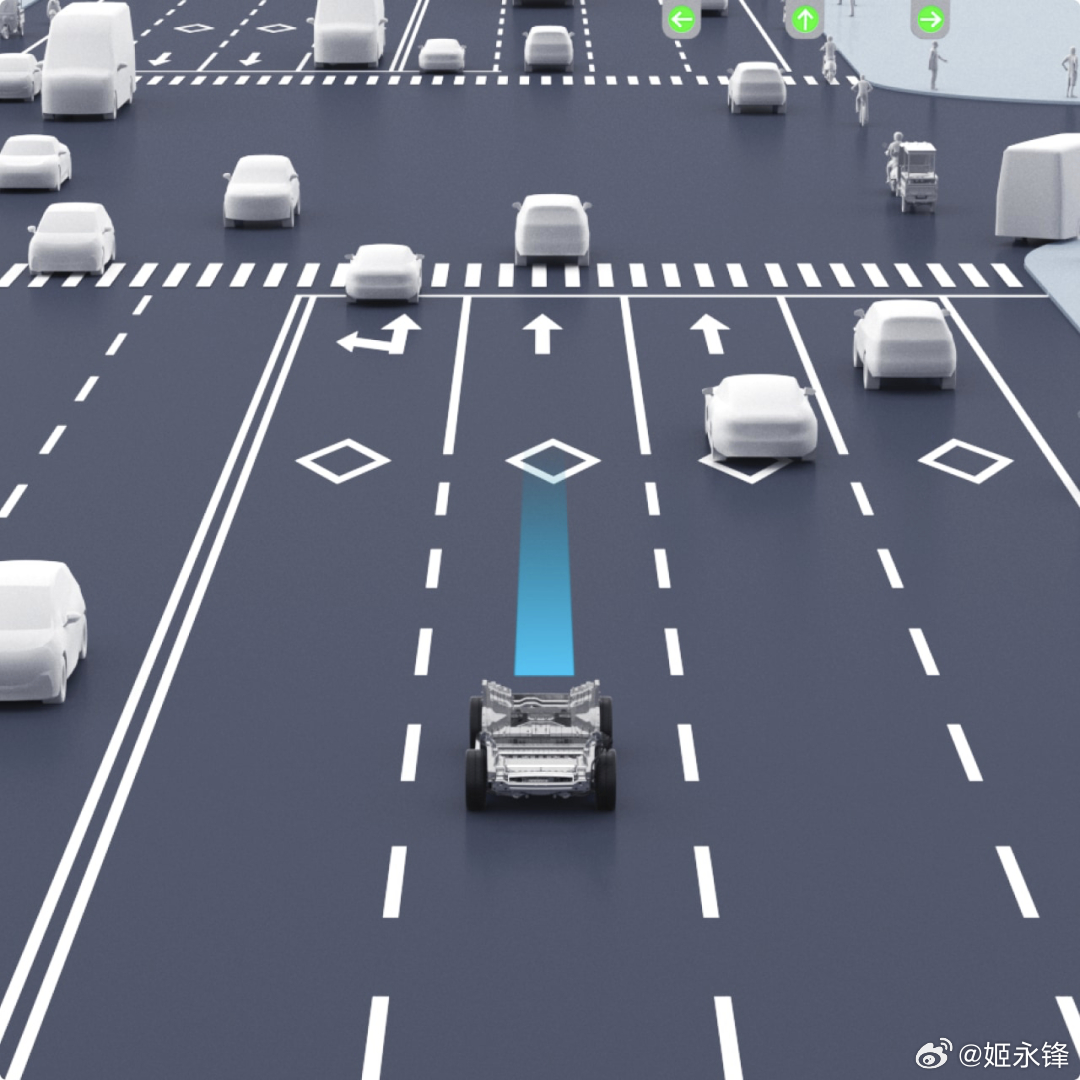

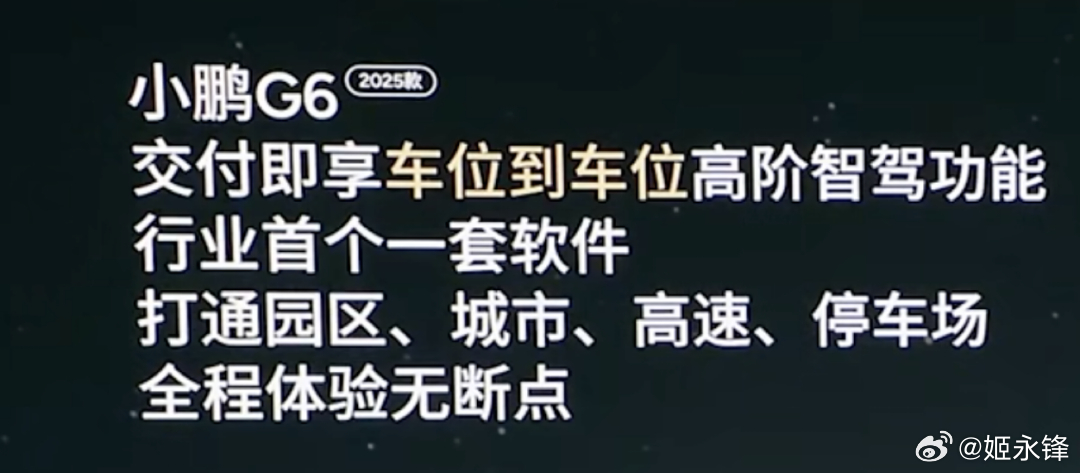

「车位到车位」智驾

小鹏汽车基于小鹏图灵AI智驾和端到端大模型,将「车位到车位」在AI天玑5.5.0上全量推送。

车位到车位功能是XNGP系统的一个功能延伸。XNGP旨在实现全场景的智能辅助驾驶,而车位到车位功能进一步完善了全场景的覆盖,将辅助驾驶从城市道路、高速路延伸到了停车场等场景,实现了从P挡到P挡的无断点通行(场景包含:自动泊出车位、跨层驶出、自动出停车场闸口、园区内通行、道路行车等)。它基于XNGP的技术架构和硬件平台,实现了从起点车位到终点车位的全程智能驾驶辅助。

XNGP的研发策略

CONTENT

小鹏推出国内首个量产端到端智驾大模型,涵盖XNet、XPlanner和XBrain。这赋予XNGP强大“脑补”能力,能够“边看边开”,实时应对环岛、掉头等复杂路况。它是行业内唯一在超2595个城市历经超756万公里实车测试,通过AI训练泛化实现全国覆盖的智驾系统,成功摆脱对高精地图的依赖,凭借独特技术优势,满足消费者在复杂场景下对智能驾驶的需求。

小鹏汽车在智能驾驶技术路线上呈现出放弃激光雷达、采用纯视觉方案的趋势。从新车布局来看,2025款小鹏G6、G9已取消激光雷达,采用鹰眼纯视觉智驾,既出于降本增效考量,也得益于自身视觉算法技术的进步,其视觉感知能力大幅提升。小鹏汽车的AI鹰眼视觉方案,将后视摄像头升级为8M高清,打造出行业首个量产2K纯视觉占用网络(OCC),提升了感知准确性,使路径规划更直接,反应速度更快。