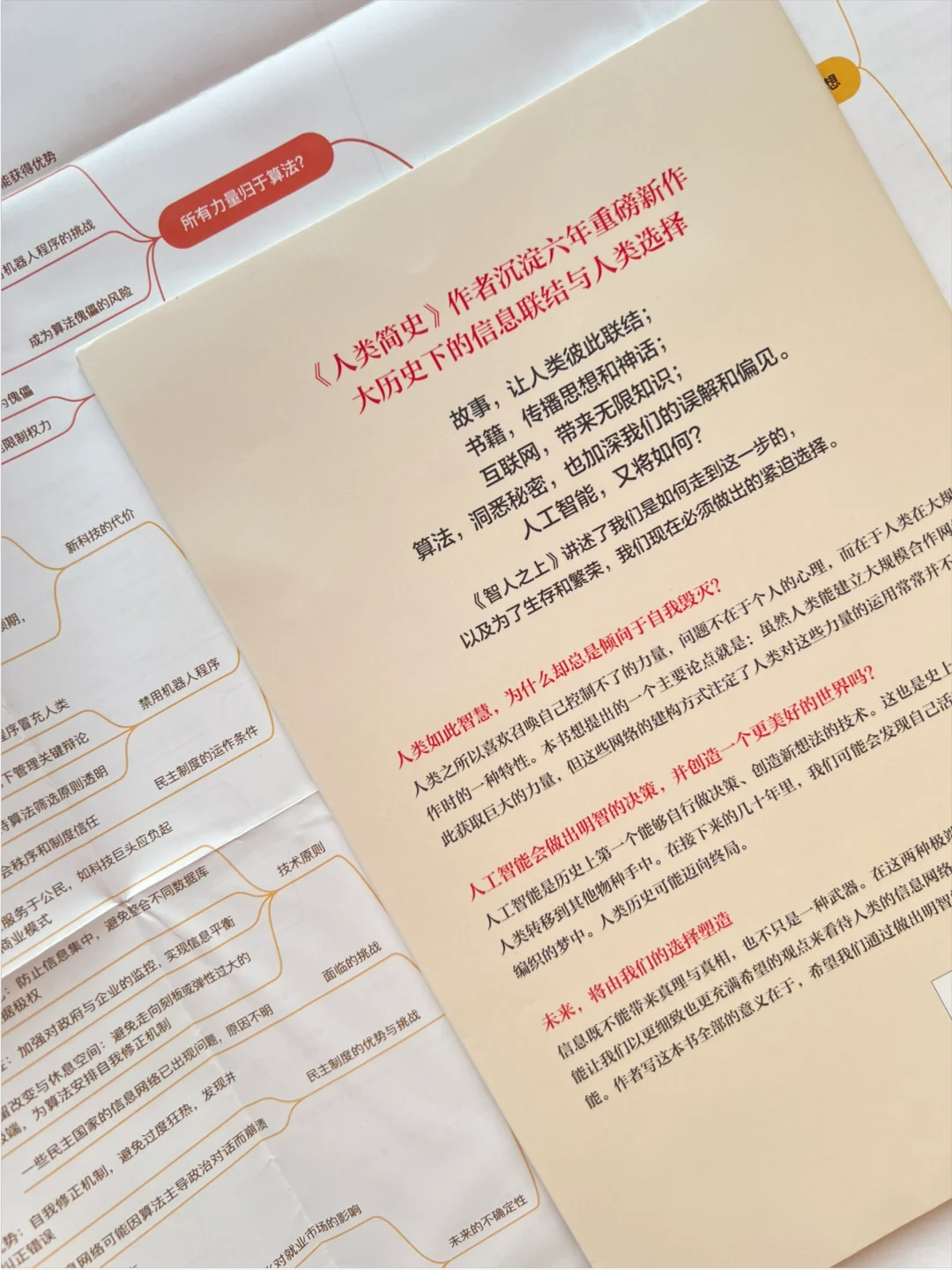

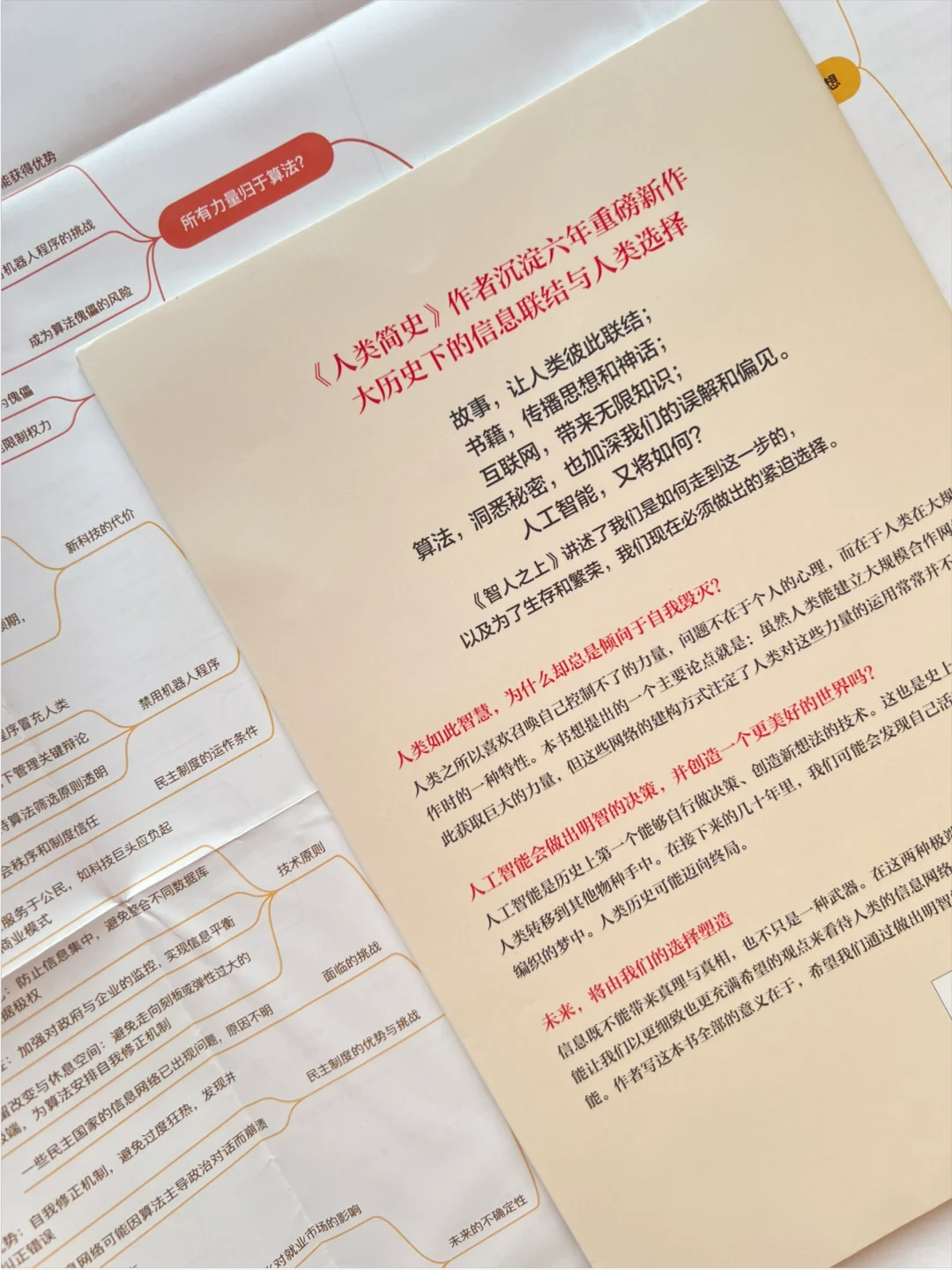

九月份中信出了本新书《智人之上》,作者是大名鼎鼎的尤瓦尔·赫拉利,《人类简史》《时间简史》《未来简史》的作者。《智人之上》接着《未来简史》讲我们人类正一头扎进可能毁灭我们自身的、由新型网络组成的人工智能时代。

——

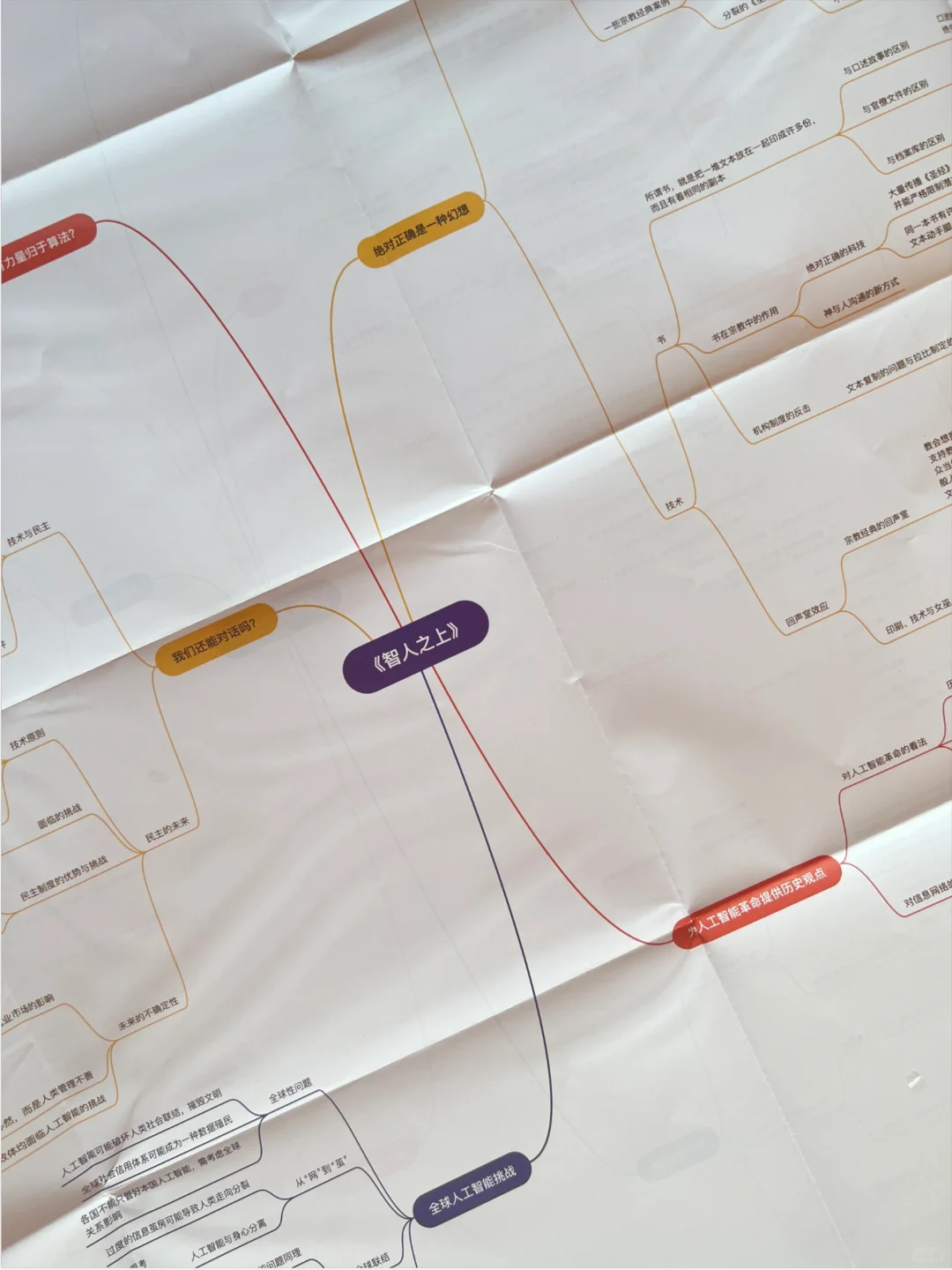

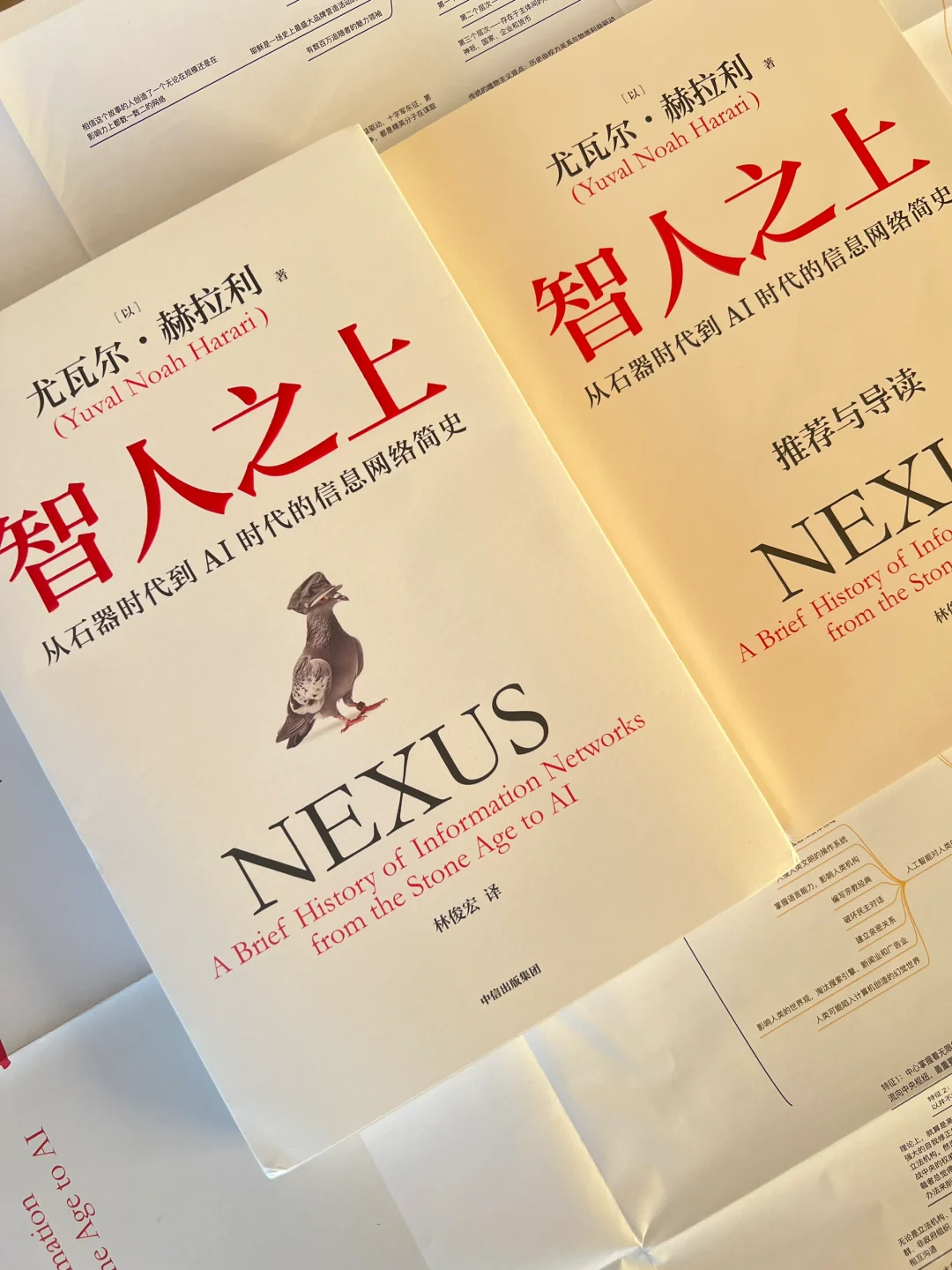

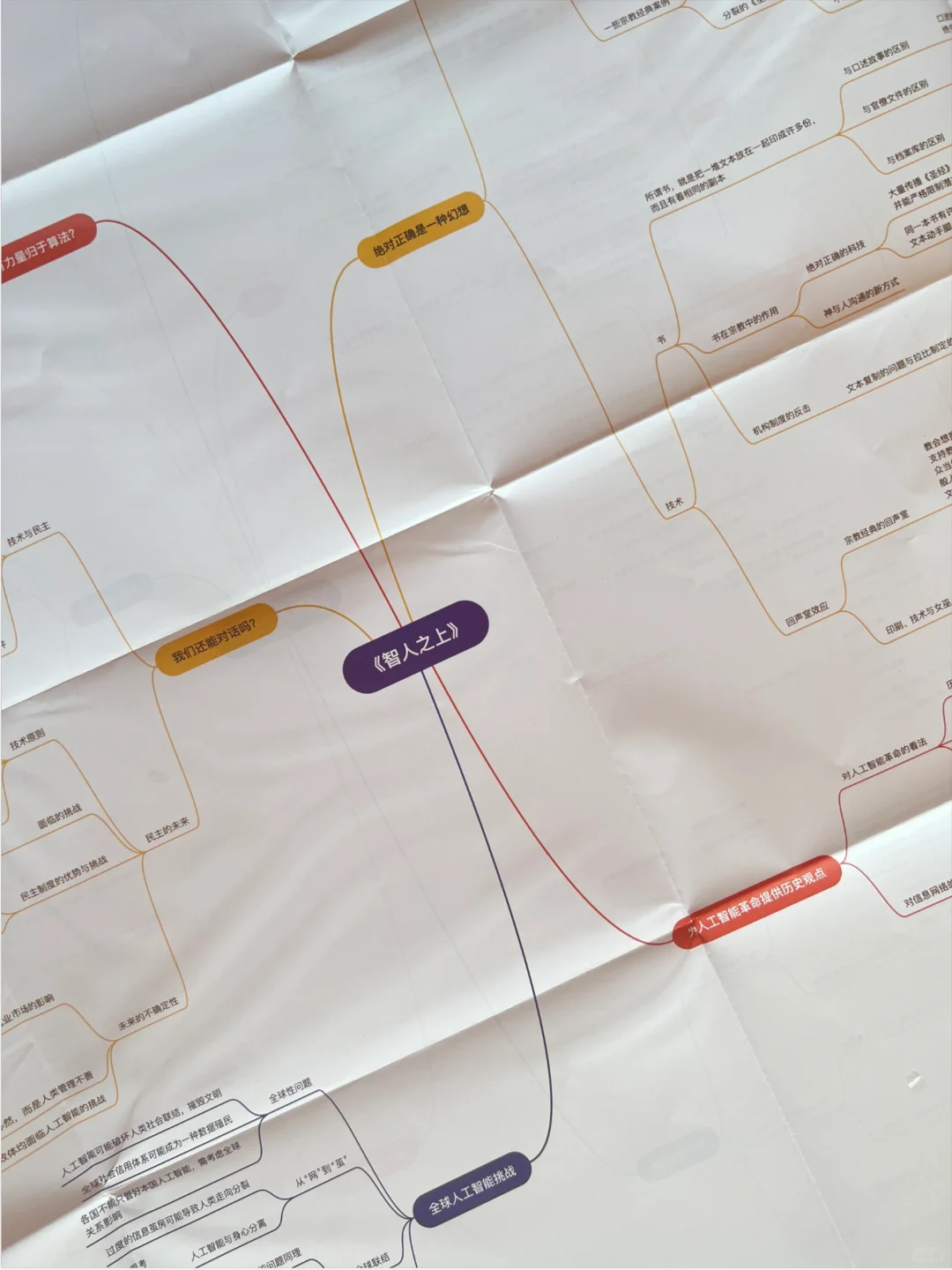

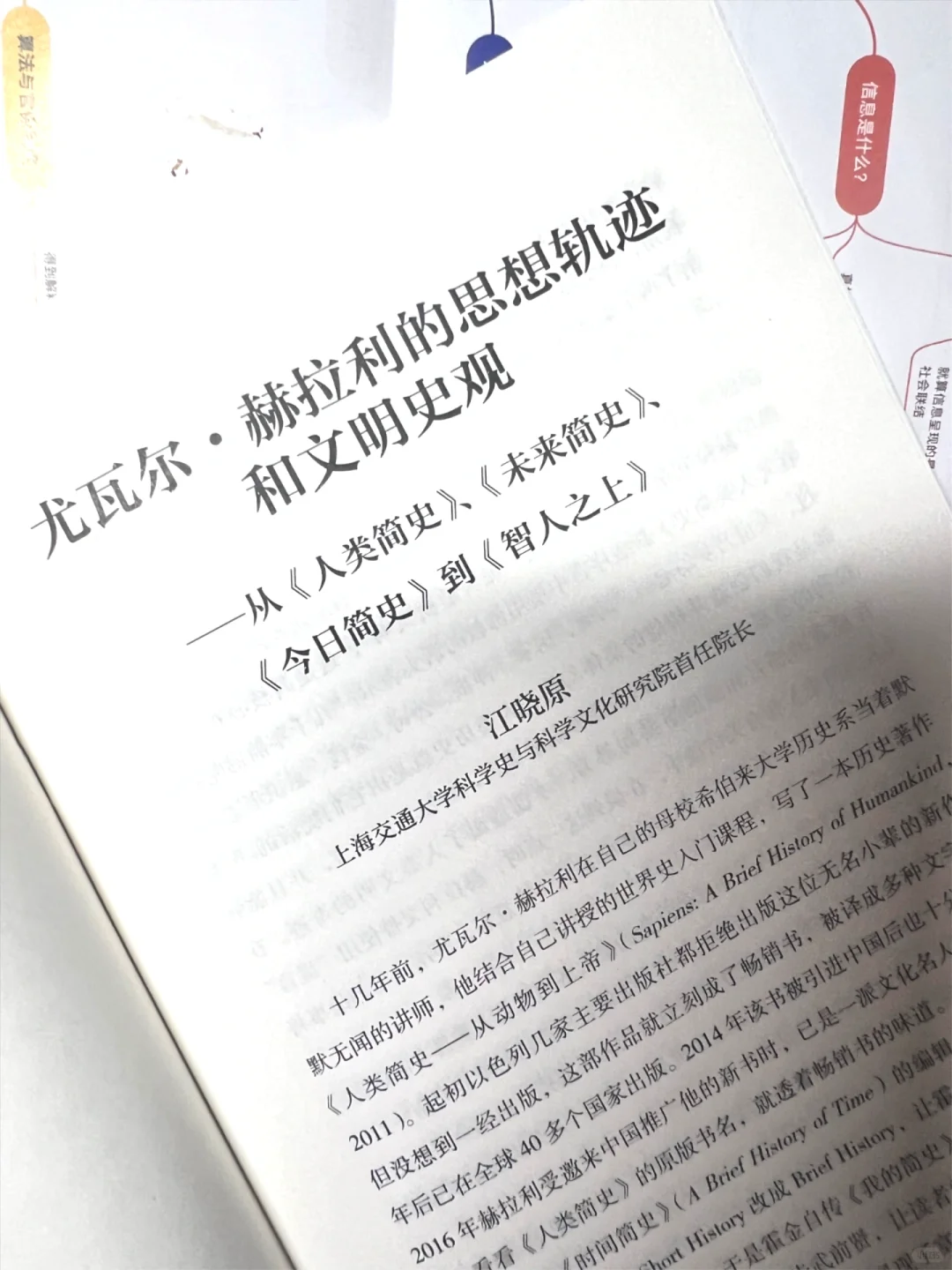

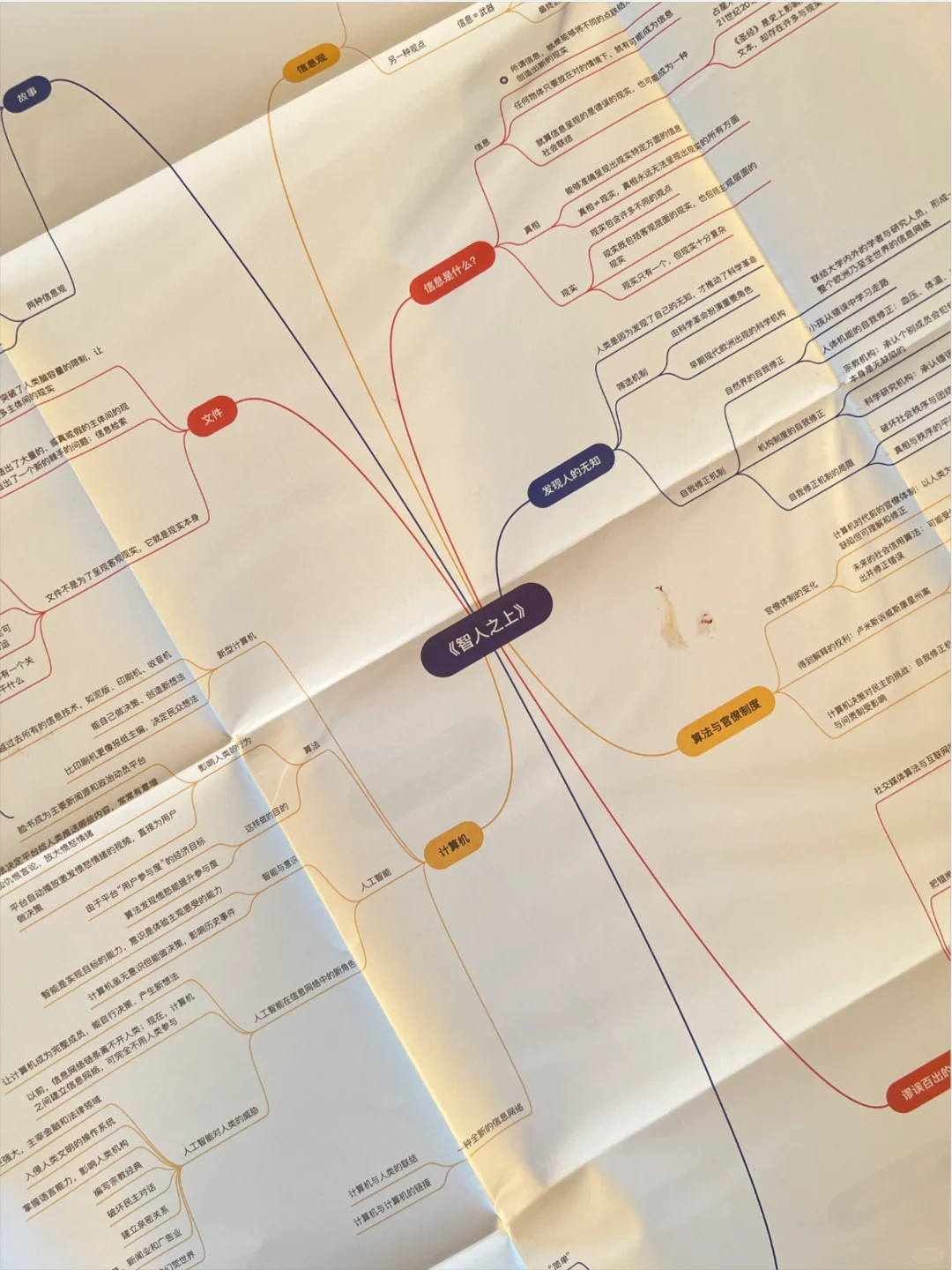

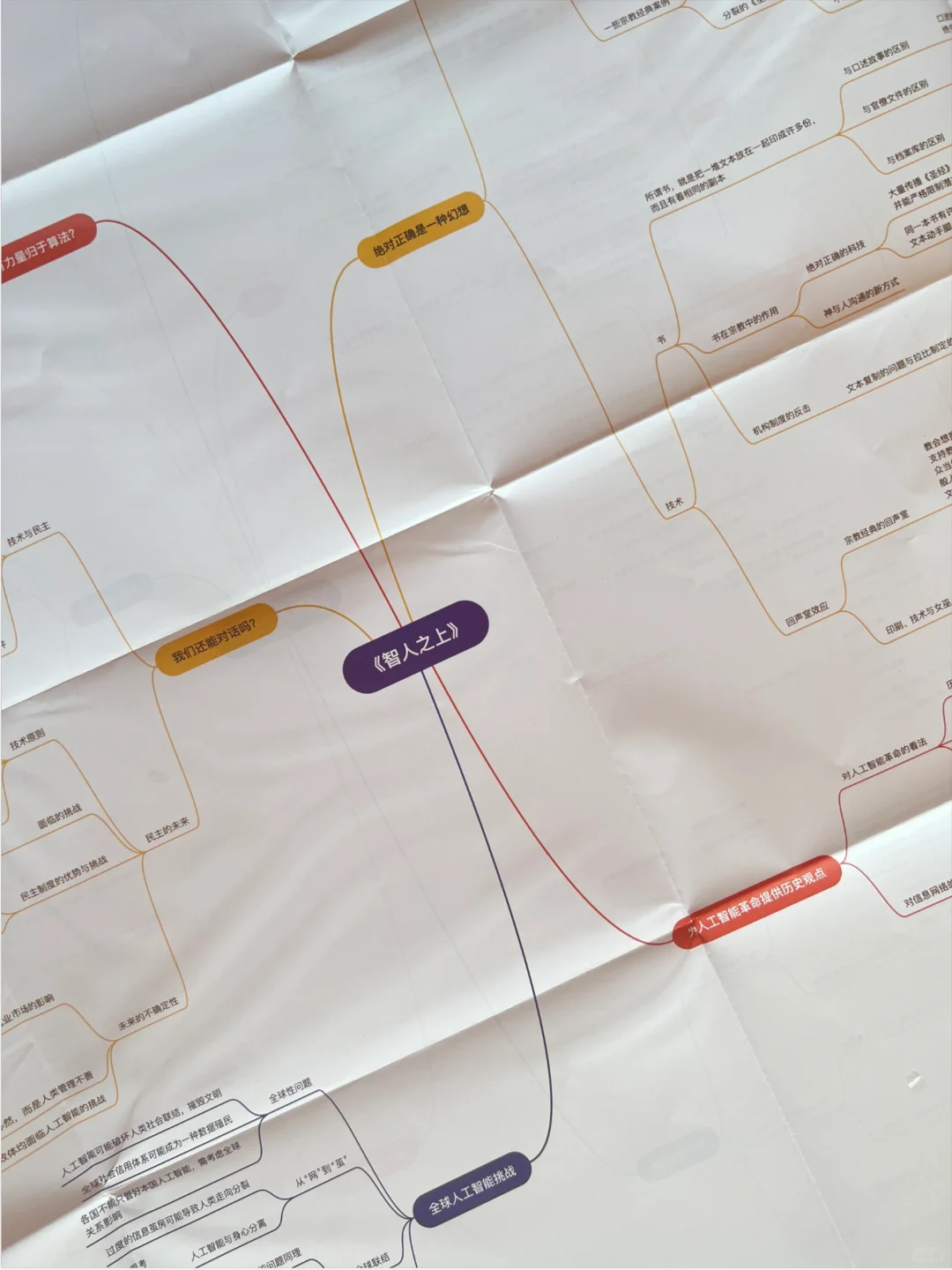

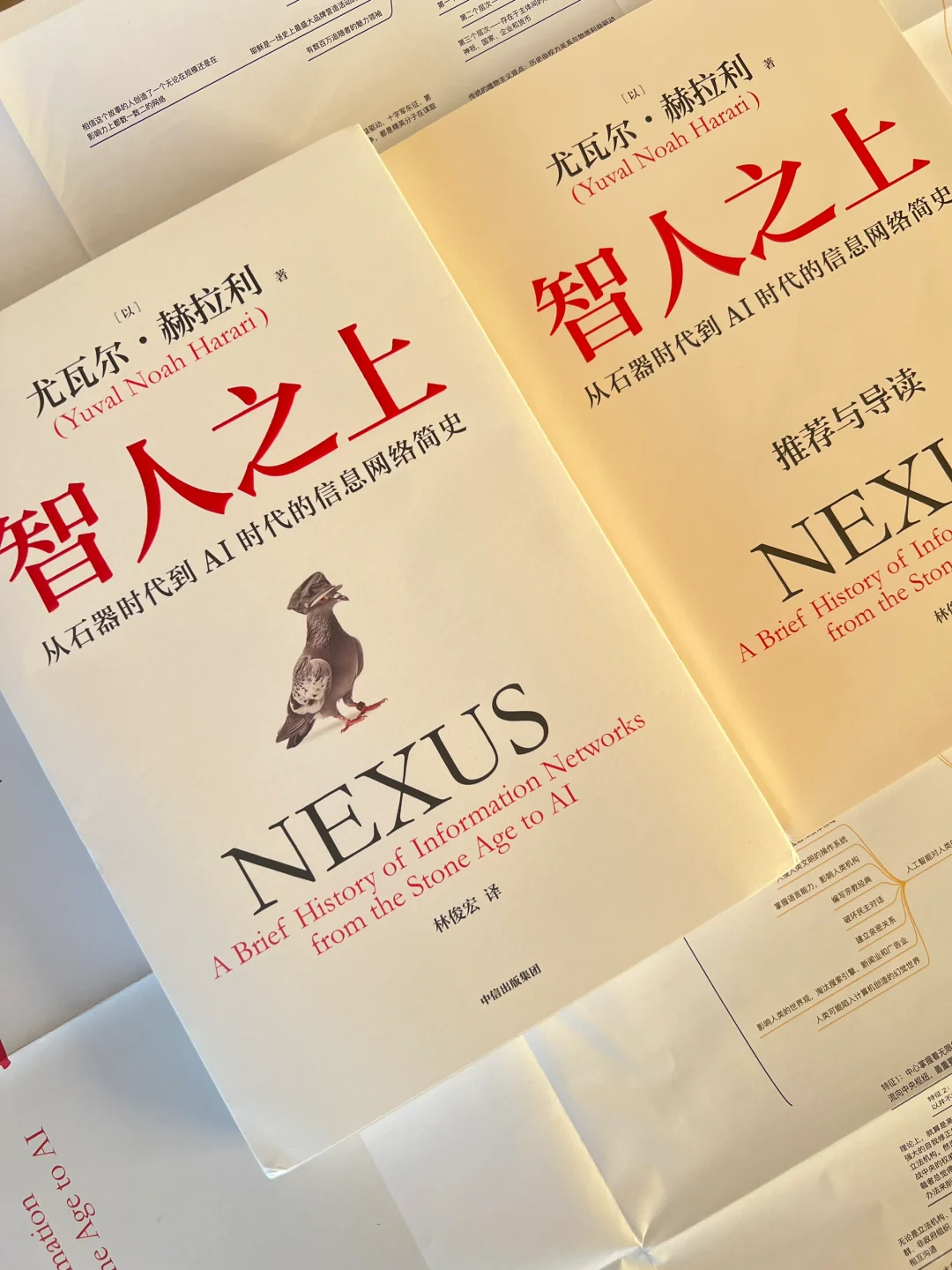

本书翻译策划相当用心,一本原著译本+一本名家推荐与导读+一张思维导图,强强组合。译者为台湾师范大学翻译研究所林俊宏博士,推荐者为李开复、张亚勤、许纪霖、刘擎、尹烨、胡泳、罗振宇、吴冠军等十七位专家学者,导读者为江晓原、刘嘉、周航、吴甘沙、洪灏、严飞等六位专家学者,他们撰写了精彩的推荐语和导读文章,对我们理解本书大有裨益。

——

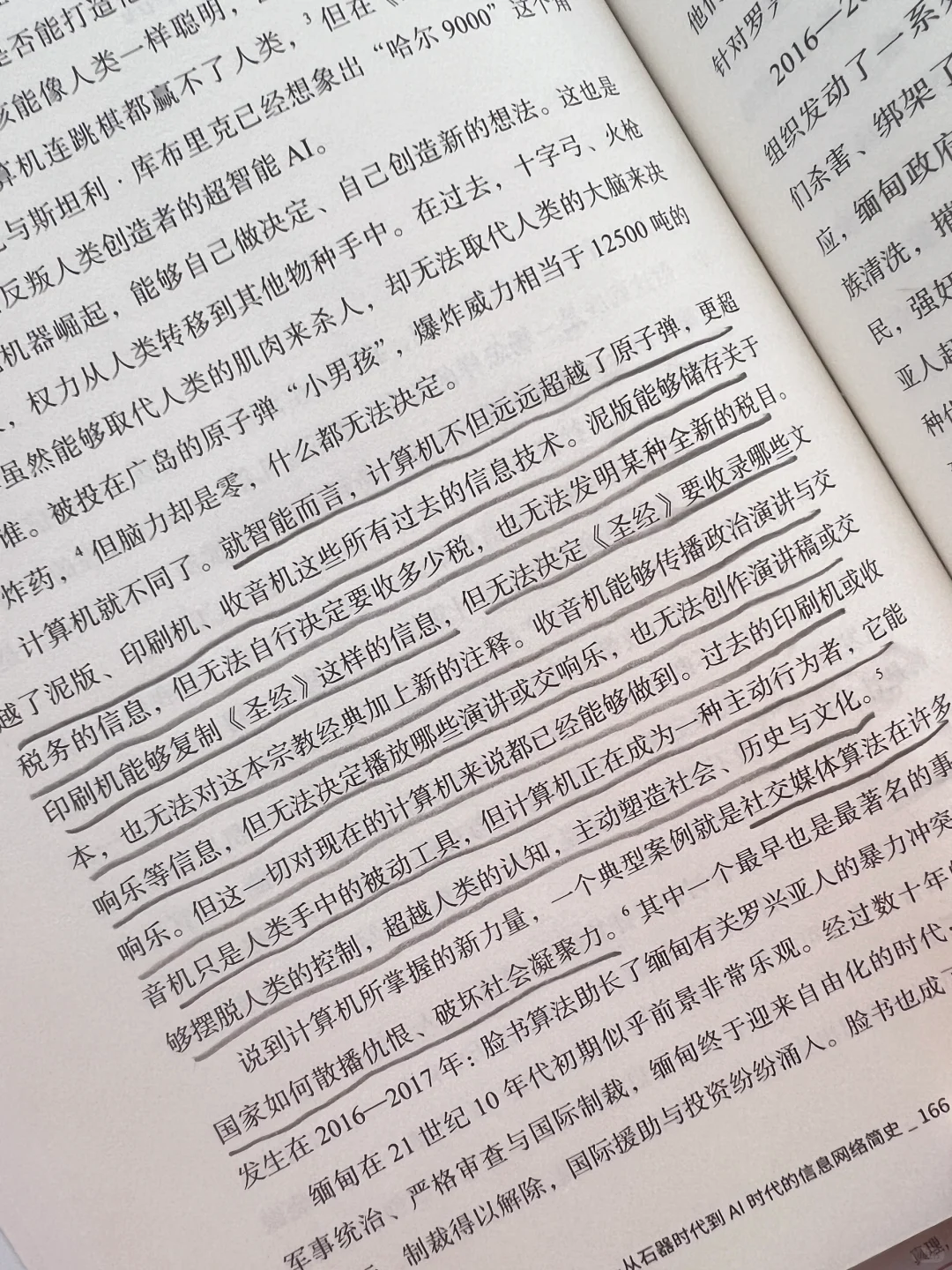

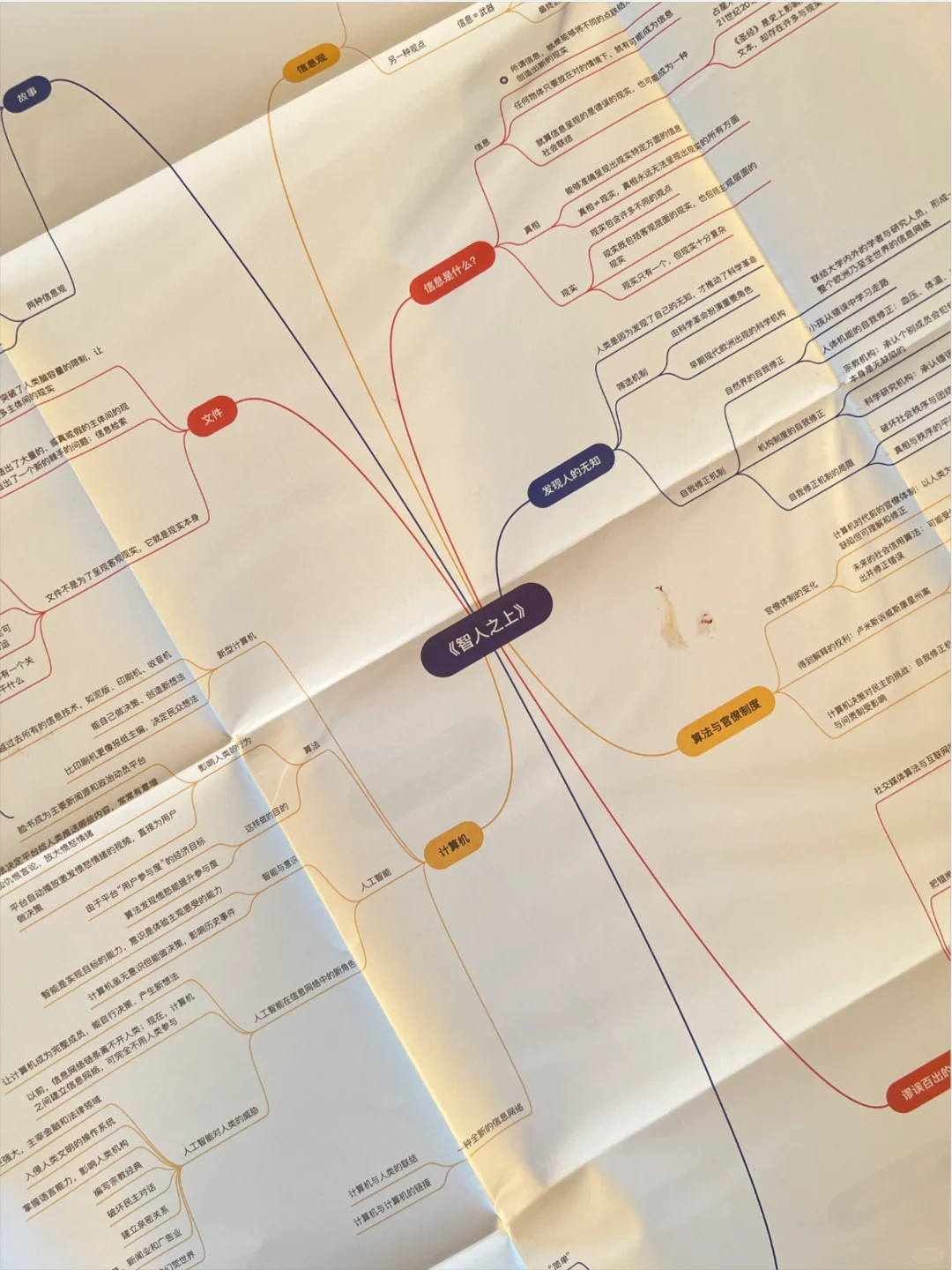

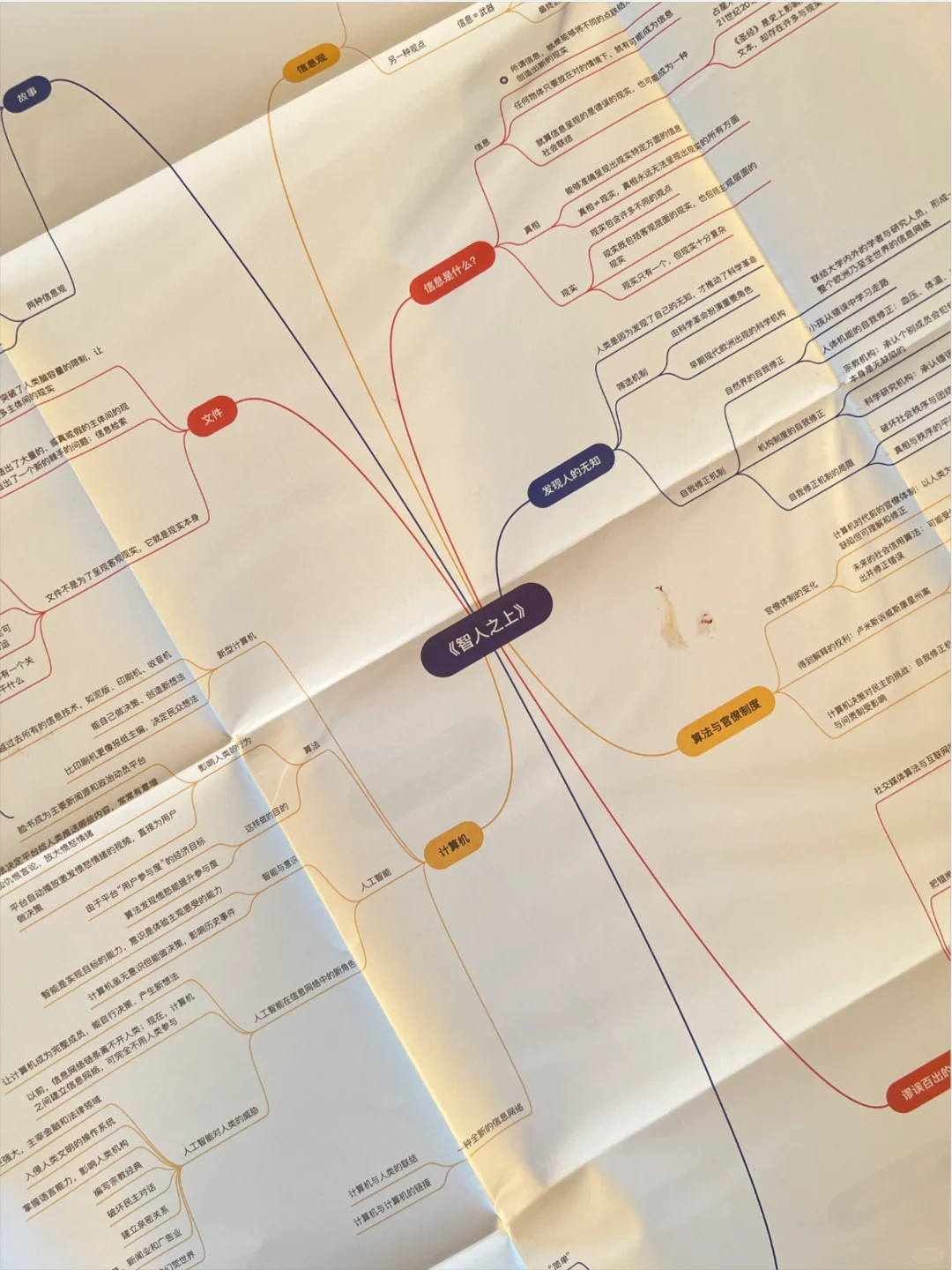

与原子弹毁天灭地的巨大威力相比,信息网络与人工智能看似要温和温柔得多,但实际上可能更加可怕。原子弹无脑,只能被人操纵,而人工智能可以自我学习,甚至有可能产生自由意志,如果处理不当,不仅会消灭人类的主宰地位,更会让宇宙变成黑暗世界。在本书当中,赫拉利对人类(智人)与宇宙的未来表达了深重的忧虑。

——

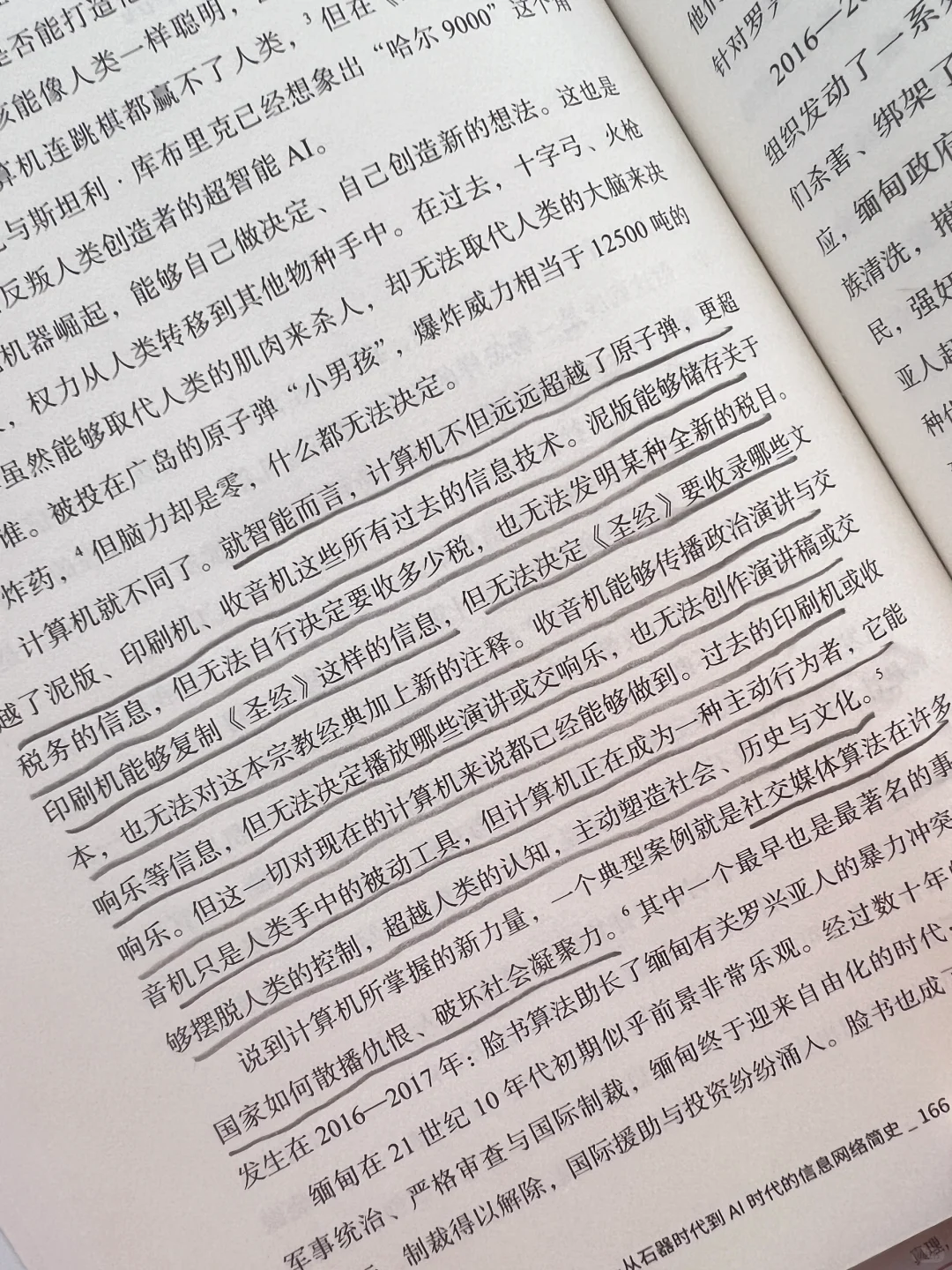

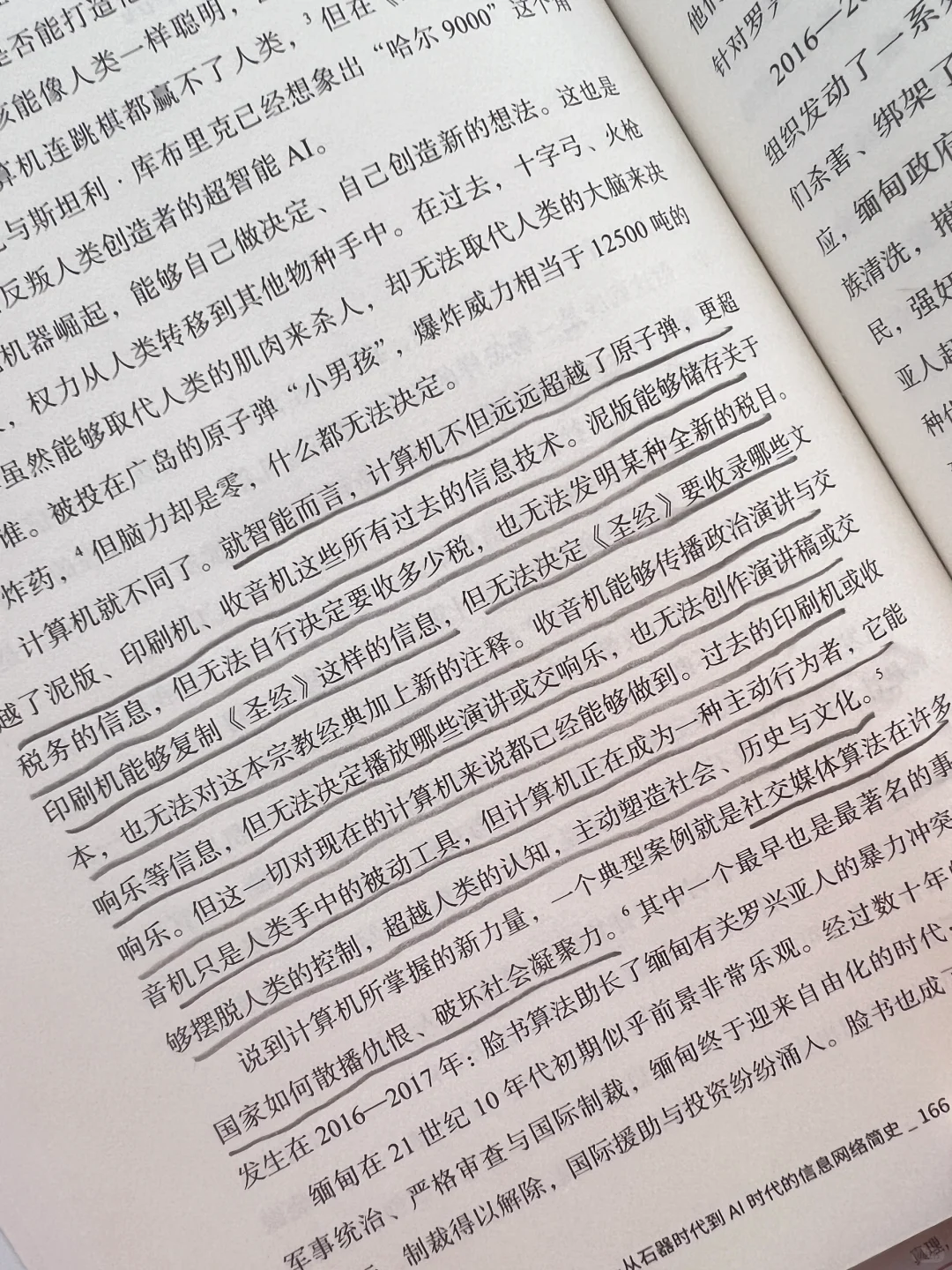

本书指出,信息不是越多越好,以为信息越来越多终将导向真理和真相是大错特错的。赫拉利以缅甸罗兴亚人的遭遇为例说明了脸书的算法在制造假新闻、散播仇恨、破坏社会凝聚力、导致大规模的暴力冲突方面所扮演的负面角色。为什么算法助长的不是慈悲而是愤怒呢?赫拉利发现,比起慈悲的布道,充满仇恨的阴谋论更能提升人类的参与度。所以为了追求用户参与度,算法做出了一个致命决定:传播愤怒。其结果是大约25000罗兴亚人遭到清洗。

——

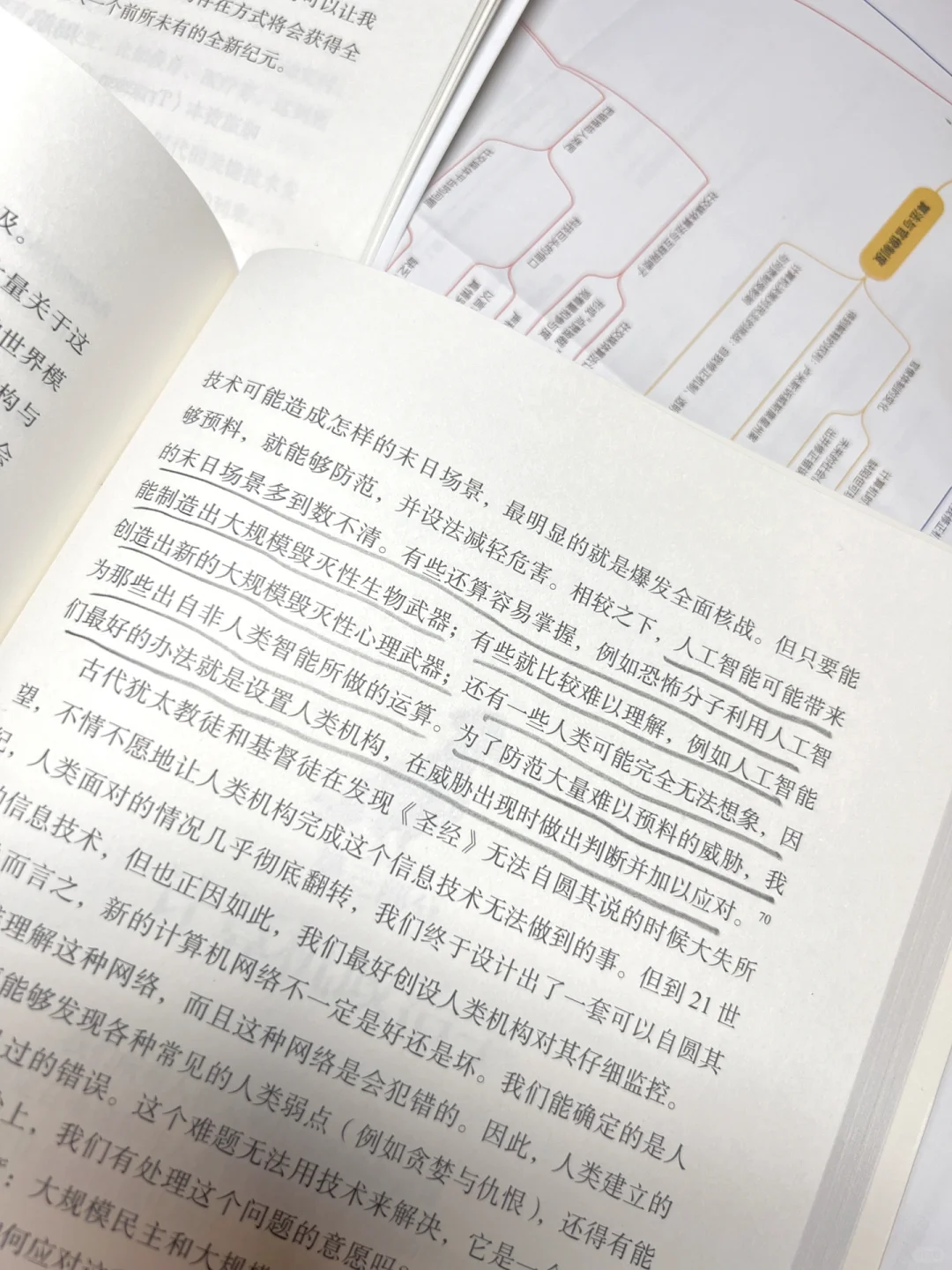

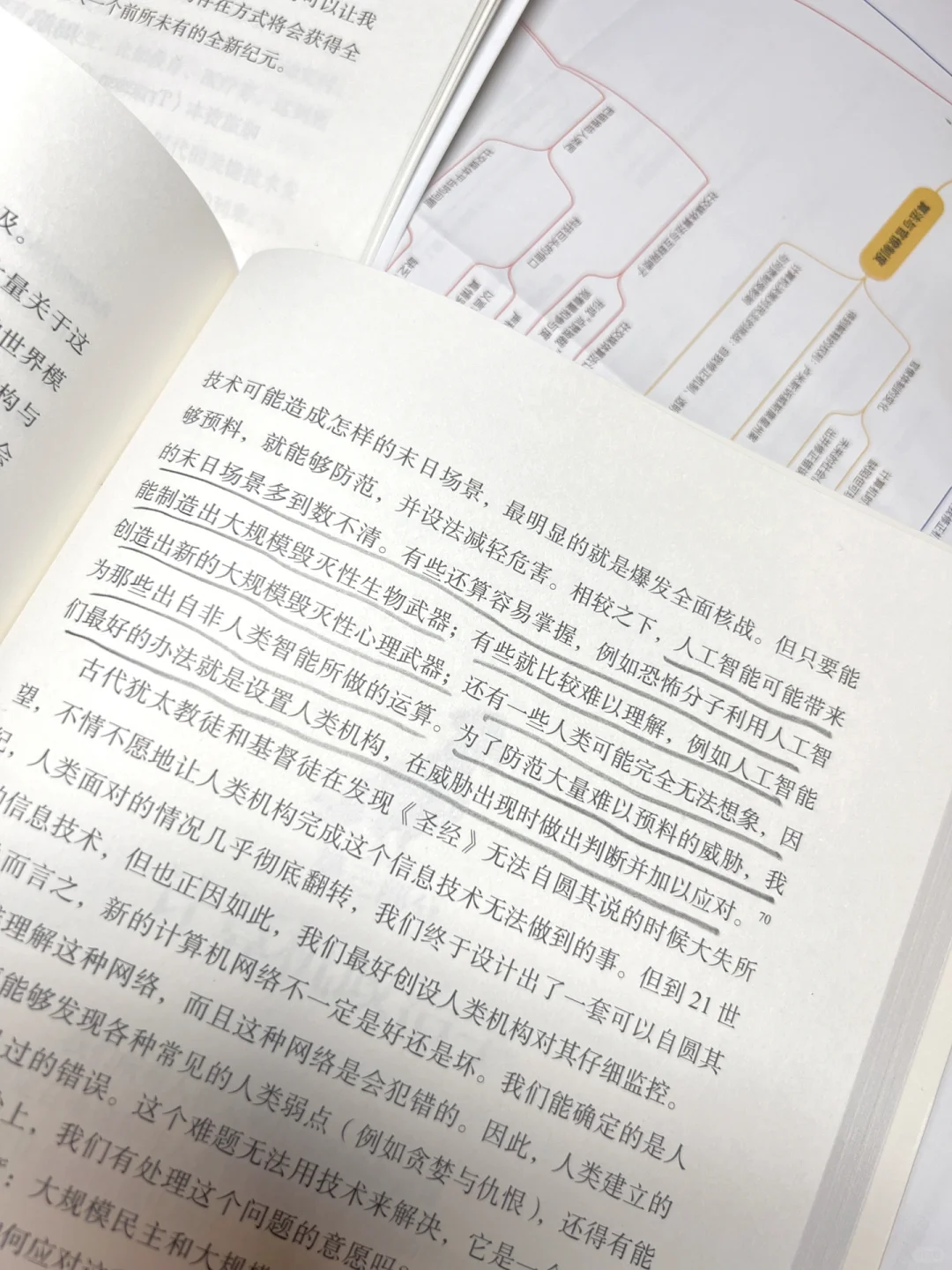

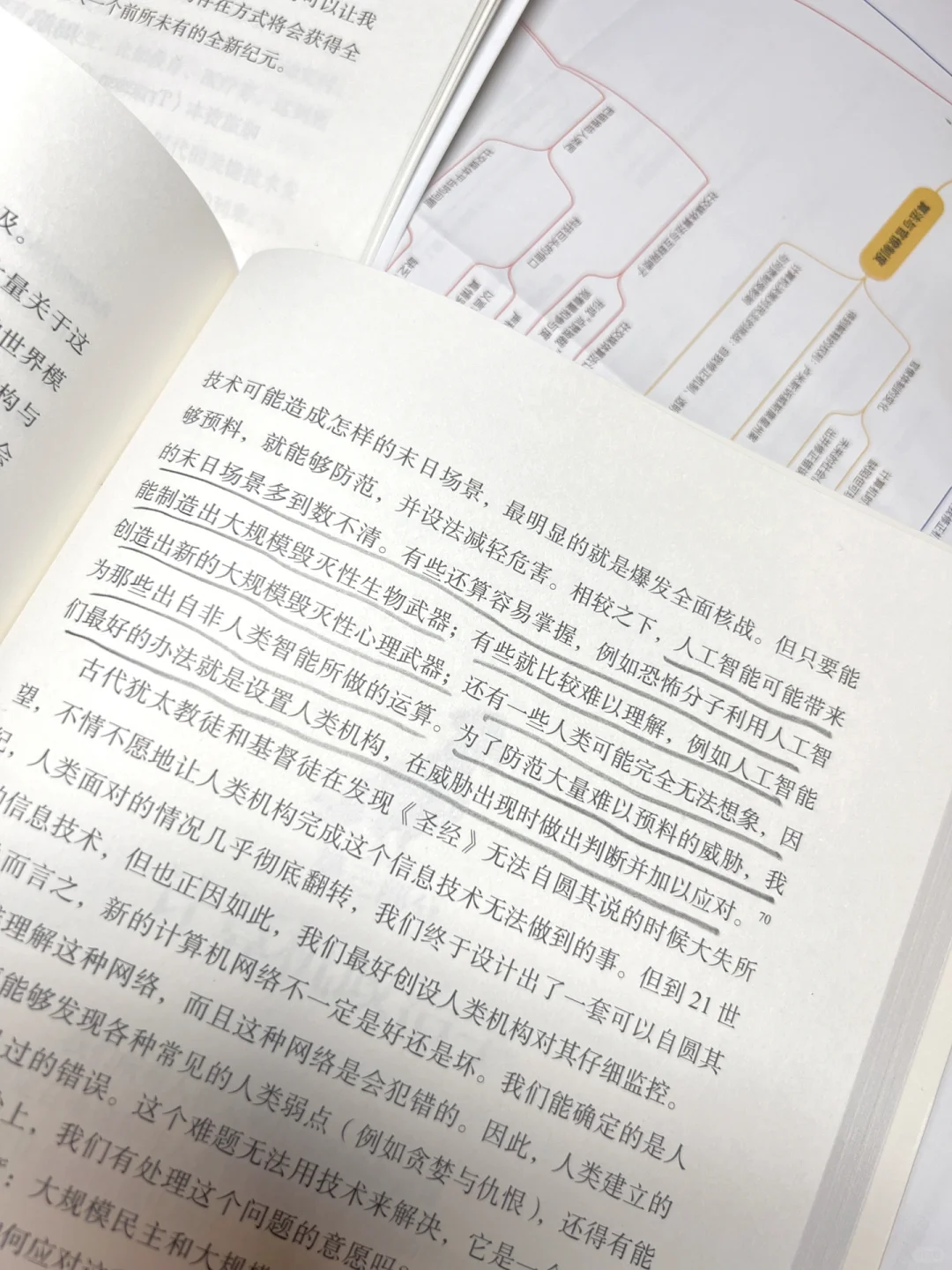

本书讨论了计算机偏见问题。研究显示,计算机虽然不是非生物实体,也没有意识,但又确实拥有类似数字心灵的东西,同样可能有种族歧视、厌女、恐同或反犹太主义倾向。为什么会有这种情况?需要了解算法的历史。赫拉利认为,社交媒体算法以为自己发现了人类喜欢感到愤慨,但事实上正是算法让人产生与接收到更多的愤慨情绪。也因此,作者强调指出,不论算法是否意识到自己可能出错,我们都不该在这个过程中完全排除人类的参与。鉴于人工智能可能带来的末日场景多到数不清,最好的办法就是设置人类机构,在威胁出现时做出判断并加以应对。

——

18π

共读了